Prolog

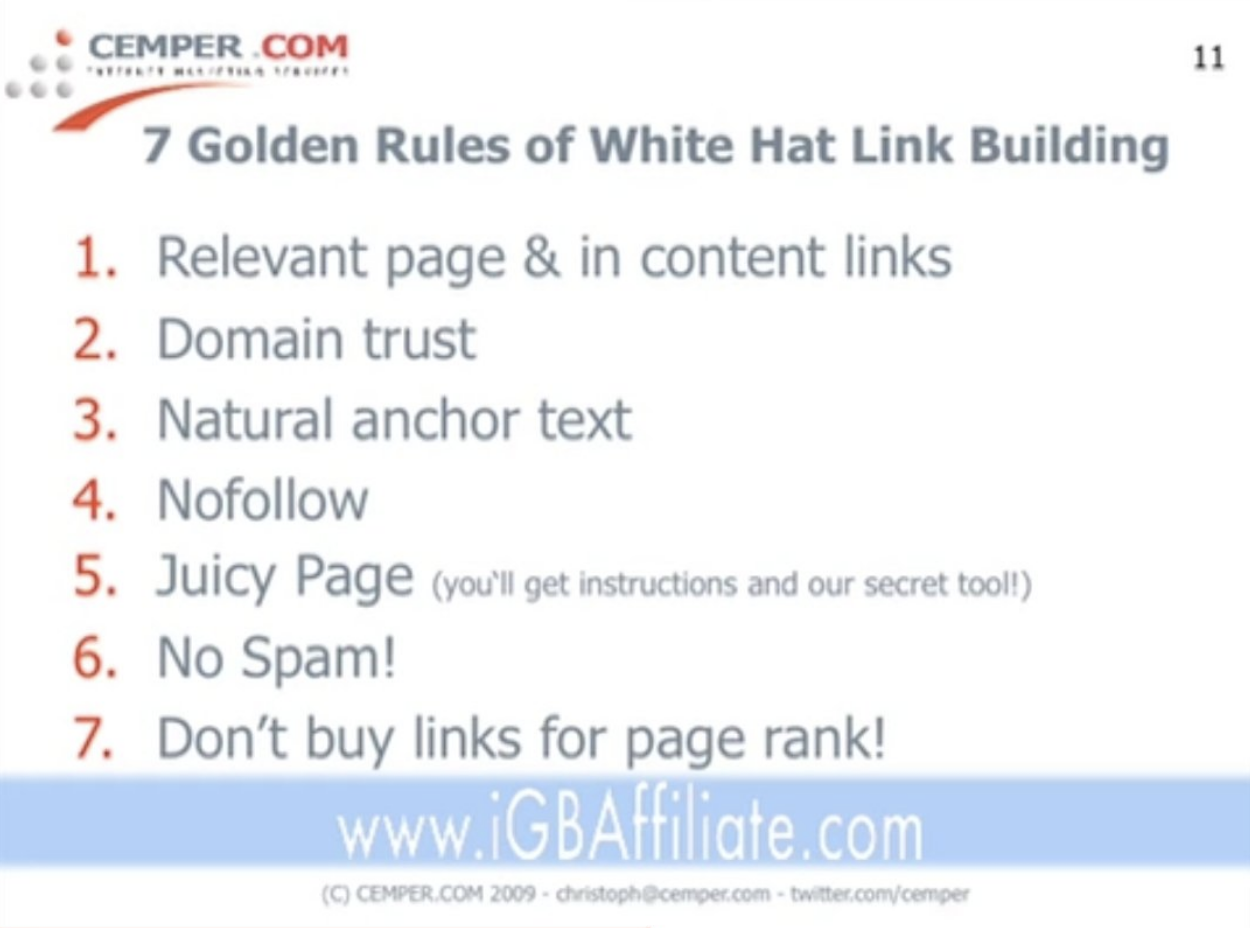

Im Mai 2009 habe ich auf der A4UExpo zum ersten Mal meine 7 Goldenen Regeln des Link-Building vorgestellt. Sie denken vielleicht, dass sich seit 2009 im Bereich SEO und Link-Building viel verändert hat, und das stimmt auch. Aber meine Kerngedanken und Konzepte des Link-Building haben sich nicht geändert.

Jetzt habe ich meine ursprünglichen „Goldenen Regeln“ für 2022 überarbeitet und aktualisiert. Ich habe versucht, heute übliche Ausdrücke wie „Traffic-Links“ (anstelle von „Links auf saftige Seiten“) und auch neue schicke Ausdrücke wie „Nischen-Edits“ einzubauen. Ich möchte damit noch einmal einige Schlüsselkonzepte verdeutlichen, die vieles von dem erweitern, was einige SEO-Expertenkurse selbst im Jahr 2022 noch falsch oder unvollständig lehren.

Die Regeln des Link-Building haben sich nicht wesentlich geändert

Wie ich schon 2009 sagte, zirkulieren zu viele falsche oder veraltete Informationen zum Link-Building; die Goldenen Regeln des Link-Building können jedem Link-Builder als Qualitäts-Checkliste für das Link-Building dienen – auch heute noch. Wenn Sie die hier aufgeführten Konzepte lesen und verstehen, benötigen Sie keine weiteren Tools. Helfen kann ein gutes Tool aber natürlich immer.

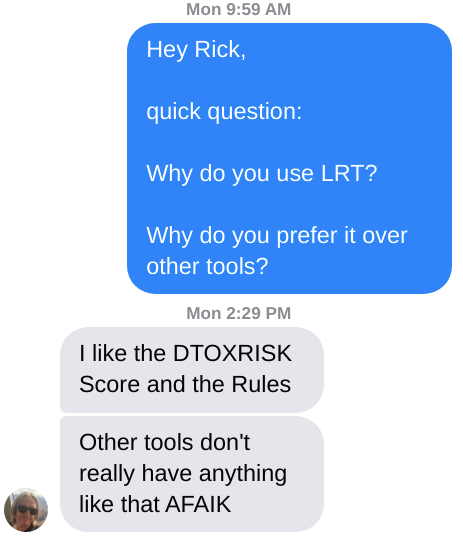

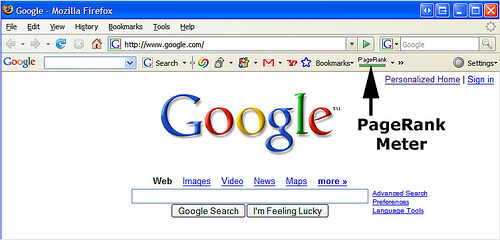

Seit 2009 haben wir Teile unseres eigenen, damals nur internen, Link-Building-Toolkits veröffentlicht und stark weiterentwickelt. LinkResearchTools (LRT) ist hilfreich, aber nicht erforderlich, um diese Regeln zu befolgen. Ich empfehle, beim Link-Building nicht zu viele, sondern eher weniger Tools zu verwenden. Die Zugänglichkeit von Domain-Metriken hat den „Zahlenwahn“ noch schlimmer gemacht, als er durch Google PageRank je war. Immerhin haben einige „Digital PR“-Agenturen schon den richtigen Weg eingeschlagen und beachten die Abdeckung, Aufmerksamkeit und die Links. Dass das der richtige Ansatz ist, hat selbst Google bestätigt. Aus meiner Sicht war das beste Link-Building schon immer das, was man heute als „Digital PR“ bezeichnen würde.

https://twitter.com/JohnMu/status/1352967238442229762

Die Kapitelstruktur wurde seit 2009 nicht mehr verändert, woran Sie erkennen können, dass diese Regeln echte Evergreens sind. Auch wenn manche denken, dass sich Link-Building und SEO stark verändern, ist das nicht so.

Die Wirkung von (falschen) Links hat sich verändert

Die bedeutendste Veränderung im Link-Building war die Einführung des Google-Penguin-Algorithmus. Google Penguin hat die Welt des Link-Building und der SEO vollkommen umgewälzt. Während früher minderwertige Links kaum Schaden anrichten konnten (es sei denn, sie waren in riesigen Mengen vorhanden), müssen die SEOs in der Post-Penguin-Welt nun jedem Link ein potenzielles Risiko zuschreiben. Das Kapitel Kein Spam! Low-Risk-Links deckt diesen Aspekt ab.

Die Wirkung von NoFollow-Links hat sich (offiziell) geändert

Die zweite bedeutende Veränderung erfolgte, als Google endlich – zehn Jahre nach meiner Empfehlung, trotzdem NoFollow-Links aufzubauen – bestätigte, dass sie auch NoFollow-Links zählen würden … wenn sie Lust dazu hätten. Wie Sie sehen können, habe ich schon immer NoFollow-Links aufgebaut und dies auch empfohlen, und zwar aus einem einfachen Grund: NoFollow-Links können wichtig sein. „Schauen Sie einfach bei Wikipedia nach“, ist das, was ich dazu normalerweise sage.

Hab's ja gesagt :-)

Damit könnte man in dieser und in vielen anderen Belangen des Link-Building stolz sagen: „Ich hab's ja gesagt“. Denn seit 2003 wache ich jeden Tag auf und denke nur an Links. Ich bin mir nicht sicher, ob es auf der Welt jemanden gibt, der auch so „Link-zentriert“ wie ich ist, aber wenn Sie es sind, würde ich furchtbar gerne mit Ihnen über Links diskutieren. Verstehen Sie mich nicht falsch – es gibt viele großartige Link-Builder da draußen, aber einige der besten scheinen unter dem Radar zu bleiben, so wie es immer war. Also: Keine Scheu – melden Sie sich bei mir!

Viel Spaß beim Stöbern und Lernen!

Christoph C. Cemper

1. Link-Relevanz, Link-Standort, nützlicher Inhalt

Links müssen relevant sein – aber wie?

Links müssen relevant sein. Das ist seit 2005 für mich DIE Grundvoraussetzung im Link-Building.

Alte Konzepte, alte Abkürzungen

Aber was bedeutet die Relevanz von Links überhaupt?

Wenn Sie Leute nach der Definition der Relevanz von Links fragen, bekommen Sie wahrscheinlich einige ziemlich alte Regeln zu hören. Simple Regeln, die dem ähneln, was ich seit 2005 lehre, und die wie in den folgenden Beispielen gestaltet sind.

Simple Regeln zur Link-Relevanz legen Wert auf die Relevanz:

- auf Domain-Ebene (z. B. blog.golfsport.de)

- auf Seitenebene (z. B. blog.golfsport.de/golf/die-besten-golfschläger)

- zum Stichwort („beste Golfschläger“)

Und manchmal hört man von zusätzlichen Relevanzbereichen, wie der Relevanz:

- auf Satzebene („Das sind die besten besten Golfschläger für Anfänger.“)

- auf Absatzebene (ein paar Sätze um den obigen Satz herum, wobei es offensichtlich um Golf geht)

- auf Ordnerebene (/golf/)

- auf Root-Domain-Ebene (d. h. golfsport.de)

Manchmal heißt es auch, dass es eine Pyramide der Wichtigkeit gebe, ähnlich der Maslowschen Bedürfnispyramide, wobei der Ankertext am wichtigsten sein soll.

Ich habe sogar schon eine auf den Kopf gestellte Maslow-Pyramide gesehen, bei der der Ankertext als Fundament bezeichnet wird (also das große flache Plateau am Boden ist), obwohl er in Wahrheit am wichtigsten ist, also an die Spitze gehört. Zunächst müssen Sie die Relevanz auf anderen Ebenen richtig einschätzen. Sonst wären alle „Klick hier“-Links wertlos.

All diese Konzepte sind Vereinfachungen und eher Annäherungen an das, auf was es wirklich ankommt.

Einfache, klare Checklisten sind gut, um das Erstellen und Verstehen von Standardarbeitsanweisungen (SOPs) zu erleichtern.

SOPs für Billiglohn-Link-Building-Leute in Entwicklungsländern, deren Arbeit von einigen Link-Building-Agenturen aus Profitgründen mit ein paar Tausend Prozent Aufschlag weiterverkauft wird.

Alles schon gesehen …

In Wirklichkeit ist aber für die Relevanz von Links noch viel mehr zu beachten als nur ein paar SOPs.

Natürliche Sprachverarbeitung

Im Jahr 2022 und darüber hinaus ist der ehemalige Simpel-Ansatz, die Money-Keywords einfach in alle Bereiche des Link-Graphen zu stopfen, schlicht falsch. Kurzfristig mag das funktionieren, aber wir sehen trotzdem jede Woche Rankingverluste und Google-Abstrafungen.

2009 war das noch einfach möglich, aber die Zeiten haben sich geändert. Mehr dazu erfahren Sie im nächsten Kapitel, in dem ich Ihnen auch den „Google-Schnuppertest“ vorstelle und in dem Sie erfahren, wie man Links richtig und natürlich aufbaut.

Sie müssen akzeptieren, dass Google jedes Jahr besser darin wird, natürliche Sprache und Kontext zu verstehen, und zwar auf viele Arten, die Sie nicht erwarten würden.

Wir leben in einem technologischen Zeitalter, in dem man zum Beispiel ein beliebiges Foto in ein Musikvideo der singenden Person umwandeln kann. Zur Linkanalyse und Bewertung von Links gehört viel mehr, als nur eine Reihe von Keywords in allen Bereichen der Seite zu betrachten.

Google ist keine bloße Ansammlung von PHP-Skripten, die auf verschiedenen Ebenen der Seite und der Domain nach Keyword-Erwähnungen suchen – und das war es auch nie. Mit der alten Lehre von der „Relevanzhierarchie“ ist es also schon lange nicht mehr getan.

Außerdem: Wie viele Golf-Websites gibt es, die (natürlich) Golfschläger für Anfänger empfehlen? Diese Art von Inhalt ist der typische Affiliate Content oder Füllstoff für jeden Publisher, der es auf Impressionsmetriken und Werbeeinnahmen abgesehen hat (wie Forbes, Business Insider und dergleichen). Sie werden sie alle finden, wenn Sie einen natürlichen Weg nutzen, um nach Links mit Traffic zu suchen, die Sie aufbauen können, anstatt nur eine Datenbank mit WordPress-Seiten auf abgelaufenen, zum Kauf angebotene Domains zu durchforsten.

Hier ist ein großartiges Beispiel von Ammon Johns, als er gefragt wurde:

Was bedeutet „Linkrelevanz“ für Sie?

„Gute Frage. Für mich ist ein Link relevant, wenn er im Kontext des Textes natürlich erscheint. Der Link darf nicht erzwungen und nicht irrelevant für den Leser sein (auch wenn er [der Link] ein wenig neben dem Hauptstrang des Inhalts/Themas liegt).

Ich kann zum Beispiel in diesem Kommentar darüber sprechen, dass ich den Leuten, die nützliche Links aufbauen wollen, immer das Buch «Purple Cow» von Seth Godin empfehle. Dann mache ich die Empfehlung zu einem Link zu dem Buch auf Good Reads oder Amazon. Die Folge ist: Obwohl es in dem Buch nicht direkt um Links oder Relevanz oder sogar SEO geht, ist der Link immer noch ein relevanter Link, und ein dazu guter.

Wenn ich Ihnen aber erzähle, dass ich beim Schreiben dieses Kommentars meinen Kaffee trinke, den ich in meiner bei Amazon gekauften Lieblings-Perkolatormaschine zubereitet habe und einen Link einfüge, dann ist das viel weniger relevant, selbst wenn der vorherige Link zu Amazon gegangen wäre. Der Link ist bloß weiter von der Absicht und dem Interesse des *Lesers* entfernt und daher weniger relevant für seine Bedürfnisse und Interessen.

Der zweite Link ist trotzdem nicht ganz irrelevant, denn im spezifischen Kontext einer SEO-Gruppe können kleine Einblicke in das Leben eines sogenannten «berühmten» SEO immer noch von Interesse sein. Außerdem haben wir SEOs im Allgemeinen ein großes Interesse an gutem Kaffee bei all den nächtlichen Jobs, zu denen uns die Inspiration geführt hat. Wir brauchen das Koffein, um weiterzumachen.“

Haben Sie bemerkt, wie der letzte Absatz oben die Relevanz des hypothetischen Links zu der Kaffeemaschine auf Amazon erhöht hat?

Das ist Relevanz.

Es gibt noch viele weitere Beispiele von anderen Experten, aber ich fand dieses hier am besten, um die Verzwicktheit der Relevanz zu zeigen und zu erklären, warum jeder Link „eine Geschichte“ haben muss.

Relevante Links haben eine Geschichte. Welche ist Ihre?

Nach meiner Erfahrung kann ein Link als relevant angesehen werden, wenn er „eine Geschichte“ hat. Wenn ein Link eine Geschichte hat, besteht er höchstwahrscheinlich auch den „Google-Schnuppertest“.

Der „Google-Schnuppertest“

Was hat Ammon in seinen Beispielen getan? Er hat uns eine Geschichte für den Link präsentiert.

Ein guter „Schnuppertest“, ob ein Link relevant oder spammig ist, ist folgender: Fragen Sie sich, ob Sie den Link einem Google-Spam-Ingenieur zeigen würden.

Stellen Sie sich vor, Sie sitzen in einer Bar, neben einem Google-Spam-Ingenieur und Sie präsentieren ihm Ihre Links.

Was meinen Sie, was der Google-Spam-Ingenieur zu Folgendem sagen würde:

- Ihren *38 Links von Golf-Websites, die sich auf Golfschläger für Anfänger beziehen**? Und die

- weiteren *62 Links von „Hobby-Bloggern“, die stündlich neue, bestens kommerzialisierbare Themen entdecken** und darüber schreiben

- und dass *89 % der Links auf gut SEO-optimierten Websites**, mit exzellenten Stock-Bildern und hochwertigen Premium-WordPress-Vorlagen, sind

- und dass die meisten der WordPress-Seiten, die auf Sie verlinken, einen starken Rückgang ihrer Linkentwicklung in den letzten 2-3 Jahren von LVT -99 % zeigen (wir können einen starken Rückgang mithilfe von LRT anhand der Link Velocity Trends oder der LVT-Metrik erkennen, die sehr negativ ist. Natürlich können Sie sich auch, wenn Sie Zeit und Lust haben, durch die Linkentwicklungsdiagramme für jeden Link klicken. Diese finden Sie in Ahrefs, SEMrush oder anderen Tools – sie alle bieten eine Art von Indikator als Diagramm)

- Insgesamt dürfte der Spam-Ingenieur während der Präsentation Ihrer Links den Eindruck gewinnen, dass Ihre „stärksten Links“ auf einem Netzwerk aus abgelaufen und dann neu aufgebauten Domains liegen, die mit aktualisierten Inhalten, geschniegelten Vorlagen und vielleicht sogar einigen Verlinkungen aus dem gleichen Netzwerk aufgehübscht und verjüngt wurden.

Der Ingenieur würde wahrscheinlich das Folgende (oder etwas Ähnliches) sagen:

„Hmmm, viele Websites, die in den letzten Jahren den Besitzer gewechselt haben und nun sowohl im Hinblick auf die Themen als auch im allgemeinen Verkehrsverhalten deutlich eingeengt sind. Auffällig ist auch, dass sie zwar weitere Inhalte zu Ihrem Thema veröffentlicht, aber nicht viele Links dazu bekommen haben.

Warum glauben Sie, dass sie sich mit Ihnen verlinkt haben?“

Können Sie diese Frage beantworten?

Hat jeder Ihrer Links eine Geschichte zu erzählen?

Um nun die Geschichte zu erzählen, müssten Sie natürlich durch jede verlinkte Seite gehen und ihre Geschichte lesen. Und wenn das einzige Bindeglied zwischen Ihrer und der anderen Website ein verlinktes Keyword ist (aus einem höchst verdächtigen, vielleicht gehackten Nischen-Edit) oder ein Satz oder vielleicht ein Absatz, der über Ihre „besten Golfschläger für Anfänger“ spricht, dann ist es wirklich an der Zeit, über mögliche Linkabwertungen oder Linkkauf-Filter oder Abstrafungen nachzudenken, die Sie vielleicht schon haben.

Im Laufe der Jahre habe ich gesehen, wie offensichtliche Link-Spammer für eine Weile durchkommen, ihr „Imperium“ aufbauen und dann abstürzen, wenn ihre Links herausgefiltert werden oder sie sogar eine Abstrafung erhalten.

Wenn Sie hart genug an Ihrem Link-Spam arbeiten, erfolgreich sind und groß genug in den Suchergebnissen erscheinen, dann wird Google auf Sie aufmerksam.

Dann sollten Sie für jeden Link eine Geschichte parat haben … oder Google wird Sie durchleuchten und abstrafen.

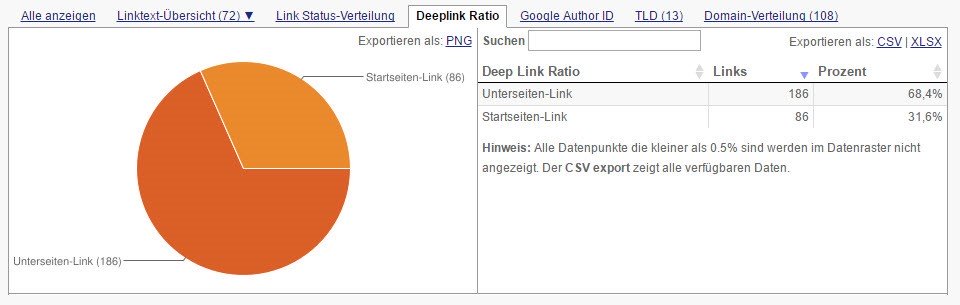

Die Linkposition sollte im Inhalt sein – aber warum?

Sie haben wahrscheinlich schon einmal den Ratschlag gehört, dass Links im Inhalt sein sollten, und zwar innerhalb eines Artikels, eines Absatzes, der (mit keyword-reichem Ankertext) über Sie und Ihr Unternehmen spricht.

Richtig – ich habe das 2009 gesagt und viele Jahre danach auch.

Aber WARUM sollten die Links im Inhalt sein?

Nach all den Jahren bin ich zu dem Schluss gekommen, dass die Empfehlung, Links, wie oben beschrieben, „im Inhalt“ zu platzieren, als Daumenregel zu grob ist.

Es ist verführerisch einfach, diese klare „Regel“ in einen Blogbeitrag, eine Präsentation und eine SOP für Ihr Link-Building-Team aufzunehmen; ich habe das auch getan. Großartig.

Wenn wir Links im Body-Inhalt platzieren, tun wir das, um die Wahrscheinlichkeit zu erhöhen, dass der Link angeklickt wird.

Wenn Sie den Standard-Ratschlag hören, dass ein Link nicht:

- in der Kopfzeile

- in der Seitenleiste

- in der Fußzeile

- hinter Bildern

... oder anderen Linkpositionen sein sollte, dann ist auch das zu stark vereinfacht.

Es gibt durchaus einige Gründe, warum Links an solchen Stellen stehen und angeklickt werden könnten, wie z. B.:

- ein großer grüner Button, der den Benutzer dazu bringen soll, sich einen weiteren Artikel oder ein Angebot zum Thema anzusehen

- eine sehr prominente Danksagung am Ende des Artikels

- ein großer, fetter und gelb hervorgehobener Link in der Seitennavigation

- ein Sponsorenbanner zwischen anderen Sponsorenbannern

Es gibt im Gegenteil sogar viele Gründe, warum Benutzer NICHT auf Links klicken, wenn sie im Body-Inhalt platziert sind.

Ein Link wird vermutlich nicht angeklickt, wenn er:

- in total langweiligen „Kauderwelsch-SEO-Content“, den sowieso niemand lesen will, eingebettet ist

- per CSS „versteckt“ wurde, denn dann ist der Link ja nicht als anklickbar zu erkennen (ja, SEOs haben das gemacht, weil sie glaubten, sich damit etwas Gutes zu tun)

- mit einer Ankertextphrase eingebettet wurde, die nur ein nichtssagendes „hier“ oder „klicken Sie für mehr“ ist. Es ist nichts Falsches daran, dem Benutzer einen Hinweis darauf zu geben, was er finden könnte. Ein solcher Hinweis hilft auch Google, die Verbindung zwischen den beiden Seiten zu verstehen.

Dies sind nur einige kurze Beispiele, um zu betonen, dass wir versuchen, Links zu platzieren, die für den Benutzer, den Besucher, den Menschen von Bedeutung sind – denn das ist es, was Google auch zu emulieren versucht.

All diese genialen Köpfe, die für Google arbeiten, haben nur ein Ziel: eine Maschine zu bauen, die das Web wie ein Mensch verstehen kann – und diese Maschine wird mit vielen „menschlichen Daten“ gefüttert.

Wenn Sie nur ein einziges Google-Patent lesen (und ich empfehle, viele zu lesen), dann lesen Sie über den Reasonable Surfer und sein Update von 2016, das ihn noch vernünftiger gemacht hat. Am besten suchen Sie dazu nach Bill Slawski, dem es seit über einem Jahrzehnt immer wieder gelingt, komplizierte Patente einfach und verständlich zu erklären.

Das Patent des „vernünftigen Surfers“ hilft Ihnen auch zu verstehen, dass das Web im Grunde nur aus Inhalten und Links besteht. Googles Ziel ist es, zu verstehen, wie Nutzer im Web navigieren. Das funktioniert NICHT, wenn man sich nur die Hyperlinks ansieht. Man muss sich alle Grundpfeiler des Webs ansehen: Inhalte, Medien und Hyperlinks.

Wenn Sie also auf einige Theorien stoßen, dass Google keine Links verwenden würde oder versucht, keine Links zu verwenden, dann denken Sie an den „vernünftigen Surfer“ von Google.

Überlegen Sie, wie Menschen auf Webseiten navigieren würden. Die meisten Leute verstehen das, aber ein paar gut gemachte Präsentationen eines geschickten Vermarkters haben vor einigen Jahren halb Deutschland verwirrt und das Konzept von Inhalt und Links (als die beiden Teile, die das Web ausmachen), verzerrt.

(dies ist wieder eine legendäre Veranstaltung mit Ammon Johns)

Da geht er also hin, Ihr **142. Link von einer Website über Golf** und alle Arten von Golfschlägern und Regeln auf Dutzenden von sehr ähnlichen Seiten, die speziell zu Golf geschrieben sind, mit einem eingebetteten Link zu Ihrem Golfshop. Es wäre auch zu schön gewesen …

Aber ganz im Ernst: Wer muss oder will schon all dieses ähnliche Zeug über die besten Golfschläger für Anfänger lesen? 80 % dieser ähnlichen Links werden von Google wahrscheinlich völlig ignoriert.

Denken Sie bei diesen Links an die Geschichte. Was ist der Sinn, dass sie dort sind? Wie schaffen sie einen Mehrwert?

Oder sind sie genauso nutzlose Inhalte, die das Web zumüllen, wie diese 11 echten Spam-Beispiele?

Natürlich möchten Sie eine Seite, die über Ihre Branche, Ihr Unternehmen, Ihre Produkte oder für Sie relevante Themen spricht. Selbstverständlich möchten Sie auch, dass Golfspieler davon erfahren und über den Link auf Ihre Partnerseite gelangen, die genau die richtigen Golfschläger für Anfänger anbietet. Aber: Würde eine echte Empfehlung heutzutage nicht die Marke, die die Golfschläger herstellt, in den Vordergrund stellen oder zumindest auf eine Amazon-Ergebnisseite verweisen?

Was ist der Wert, den IHRE Seite zur Welt beiträgt?

Bauen Sie Links zu nützlichen Inhalten auf

Wenn die Seite, auf die Sie verlinken, nützlich ist, dann haben Sie schon einen Teil Ihrer Geschichte im Sack!

IHRE Seite (auf die der Link verweist) muss nützlich sein, nicht nur schön.

Unnatürliche Links verweisen auf nutzlose Füllinhalte.

Niemand, der bei klarem Verstand ist, würde minderwertige Inhalte empfehlen und darauf verlinken … wenn ihm dazu nicht ein Anreiz geboten wurde.

Indem Google die Nützlichkeit und damit die Qualität der Zielseite betrachtet, kann es potenziell unnatürliche Links erkennen. Um das selbst zu beurteilen, können Sie natürlich Metriken zur Benutzererfahrung sammeln, aber Ihr Bauchgefühl verrät Ihnen die Antwort noch schneller.

Outreach für schlechte Inhalte ist ineffektiv.

Ihr Outreach wird bei schlechten Inhalten nicht erfolgreich sein.

Wenn Sie potenzielle Linkchancen oder Influencer, Autoren, Nachrichtenseiten, Verbände ansprechen und ihnen den „Beitrag“ präsentieren, von dem Sie sich Links erhoffen, sollten Sie sich nicht zu große Hoffnungen machen, wenn die Seite nicht genau dazu passt.

Das Web ist voll von schlechten Inhalten, und niemand wird auch nur eine Minute darauf verschwenden, auf Ihre Inhalte zu verlinken, wenn Sie keinen Zusatznutzen bieten.

Lausige Rankings für lausige Inhalte

Links zu bekommen bedeutet, Traffic und Rankings zu bekommen.

Google bewertet Ihre Inhalte, aber nicht nur die Links, die sie erhalten, sondern auch das Nutzerverhalten beim Konsum Ihres Contents. Wenn Menschen Ihre Inhalte nicht mögen, dann mag Google Ihre Inhalte auch nicht.

Das Web ist voll von mittelmäßigem Content, und es gibt nur zehn organische Ergebnisse auf der wichtigen ersten Google-Seite.

Angenommen, Ihr Inhalt ist nicht interessant zu lesen, fesselt den Benutzer nicht, ist nicht umfassend und beantwortet nicht die Fragen der Benutzer. In einem solchen Fall können Sie nicht ernsthaft erwarten, dass Sie für Ihre Inhalte gute Rankings und auch Ergebnisse beim Link-Building erhalten.

Grundlegende Kriterien für nützliche Inhalte

Die Frage, was guter, relevanter, nützlicher Content ist, ist wahrscheinlich so alt wie das Web oder die Menschheit selbst.

Folgende Prüffragen sollten Sie stellen, um zu sehen, ob es sich um gute Inhalte handelt:

- Gibt es genug Spannung und einen roten Faden durch den Artikel, die den Benutzer dazu bringen, ihn ganz lesen zu wollen?

- Kann der Leser die Liebe und Leidenschaft des Autors für das Thema spüren, oder handelt es sich um bloßes Füllmaterial, mit dem der Schreiber seine vertraglich festgelegte Wortanzahl abarbeiten will?

- Unterstützen die Bilder den Text, oder sind es nur irgendwelche zufälligen Agenturbilder, die hinzugefügt wurden, damit es im Text „auch Bilder gibt“?

- Können Sie sich vorstellen, dass einige Leser den Artikel noch einmal lesen, zumindest teilweise?

- Sind die im Artikel gemachten Angaben korrekt, vertrauenswürdig, gut erklärt und mit Quellenangaben versehen? Diese Genauigkeit ist für eher „technische“ Themen (Finanzen, SEO, Marketingtechnik, Link-Building) unerlässlich und eine Grundvoraussetzung für jede wissenschaftliche Veröffentlichung.

- Kann dieser Artikel irgendwo anders, in einer hilfreicheren Version, gefunden werden?

- Würden Sie diesen Artikel als den besten Artikel im Web zu diesem Thema ansehen? Wenn nicht, was fehlt ihm? Können Sie wenigstens auf Stellen verlinken, die die fehlenden Teile beinhalten? Denken Sie daran, das Web ist auf Links aufgebaut, und kein Artikel kann und muss alle Informationen enthalten, aber das Verlinken für eingehende Diskussionen und tiefere Erklärungen ist das, was das Web überhaupt erst erfolgreich gemacht hat.

- Kann der Benutzer den Inhalt leicht konsumieren? Denken Sie über das Inhaltsverzeichnis, Erläuterungen, die Navigationsmöglichkeiten im Artikel, Abstände, das Layout, Schriftgrößen und andere Elemente nach, die man normalerweise eher in „Benutzeroberflächen“-Jobs findet.

Bitte beachten Sie: Wir haben Tausende (sagen wir 37.937*?) weitere Spam-Beispiele und verwenden diese seit 2012 zum Training unseres Algorithmus Link Detox Genesis, aber auch zur Link-Spam-Analyse wie dieser.

2. Domain Trust

Domain Trust betrifft das Vertrauen Ihrer Domain und das Vertrauen der Domain, die auf Sie verlinkt.

Vertrauen aufbauen mit vertrauenswürdigen Links

Sie brauchen Links von vertrauenswürdigen Seiten, um vertrauenswürdig zu werden!

Je höher der Trust Ihrer Ziel-Domain ist, desto mehr kommen Sie damit „durch“.

Haben Sie sich jemals gefragt, warum Amazon immer noch so gut abschneidet und trotzdem so viele (getarnte) Affiliate-Links von (mittlerweile) abgestraften Affiliate-Spam-Websites hat?

Außerdem hatte wahrscheinlich jeder verkaufte Link jahrelang eine „gute Kozitation“ aus Wikipedia, da die Link-Builder auch dieses Konzept überstrapaziert hatten. Wikipedia hat dabei, wie Sie wahrscheinlich erwartet haben, keinen Schaden davongetragen.

Messen von Vertrauen mit Proxy-Metriken

Früher wurde das Vertrauen einer Domain anhand von Proxy-Metriken gemessen, wie z. B.:

- Domain-Alter (alte Domains genießen tendenziell mehr Vertrauen, wenn sie vertrauenswürdige Links haben)

- Markennamen (echten Marken wird tendenziell mehr Vertrauen entgegengebracht, wenn sie vertrauenswürdige Links haben)

- Kozitationen (Websites, die mit anderen vertrauenswürdigen Websites kozitiert werden, haben tendenziell vertrauenswürdigere Links)

- .edu-Links (Universitäts-Websites genießen in der Regel ein hohes Vertrauen, und von ihnen verlinkt zu werden, führt in der Regel dazu, dass verschieden viel Vertrauen übertragen wird.

All diese Faktoren und mehr können den Trust Rank einer Domain indirekt beeinflussen.

Messen von Vertrauen mit dem TrustRank-Patent

Seit 2011 gibt es eine Metrik, die das TrustRank-Patent implementiert und die viel genauer ist als die alten Annäherungsmethoden.

In LinkResearchTools können wir mit LRT Trust das Vertrauen im Hinblick auf alle Link-Scopes (Root-Domain, Host/Subdomain, Seiten-Level) messen.

Trust misst den Abstand zu einem vertrauenswürdigen Seed-Set von Websites, also den angesehensten Teilen des Webs.

Die LRT-Trust-Metrik ist eine wichtige Metrik, die bei der Entscheidung hilft, ob Link aufgebaut oder disavowed werden soll. Darüber hinaus hat die Metrik noch stärkeren Einfluss auf die weitergehende Metrik „LRT-Risk“.

Dennoch, auch im Jahr 2022 haben viele populäre SEO-Tools, die manchmal als Konkurrenten von LRT bezeichnet werden (wie Ahrefs, SEMrush, Moz), nach wie vor keine Metrik, die das Vertrauen ähnlich wie das TrustRank-Patent misst. Manche versuchen, anhand von Proxy-Metriken (wie verweisenden Domains oder organischem Traffic) eine Autorität zu messen. Dabei wird aber z. B. die Qualität des Traffics nicht berücksichtigt. Die einzige vergleichbare Metrik, die wir kennen, ist der Trust-Flow von Majestic.

Viele Linkverkäufer verwenden vereinfachte, domainbasierte Metriken, wie Ahrefs DA oder Moz DA. Manchmal werden Kunden damit von den Linkverkäufern auch über den Tisch gezogen. Allerdings fragen die Käufer von Links manchmal gezielt nur nach diesen unzureichenden und einfachen Metriken – was die Frage aufwirft, wer letztlich für die Aufklärung der Linkkäufer verantwortlich ist.

Vertrauen schaffen mit guten Kozitationen

Vertrauenswürdige Kozitationen waren und sind von großer Bedeutung, werden aber nur selten thematisiert. Das habe ich in diesem Beitrag und vielen anderen zuvor getan.

Ein bekannterer Begriff, wenn es um Link-Building geht, ist **schlechte Nachbarschaft** (Bad Neigborhood).

Schlechte Nachbarschaft wird manchmal vereinfacht als „spammige Websites auf demselben Webhoster“ beschrieben, aber das sollte nicht Ihre große Sorge sein, nicht im Jahr 2009 und schon gar nicht im Jahr 2022

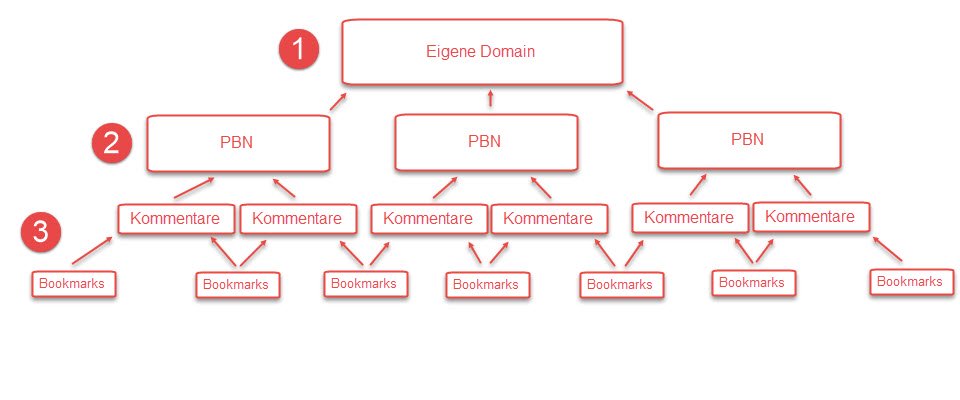

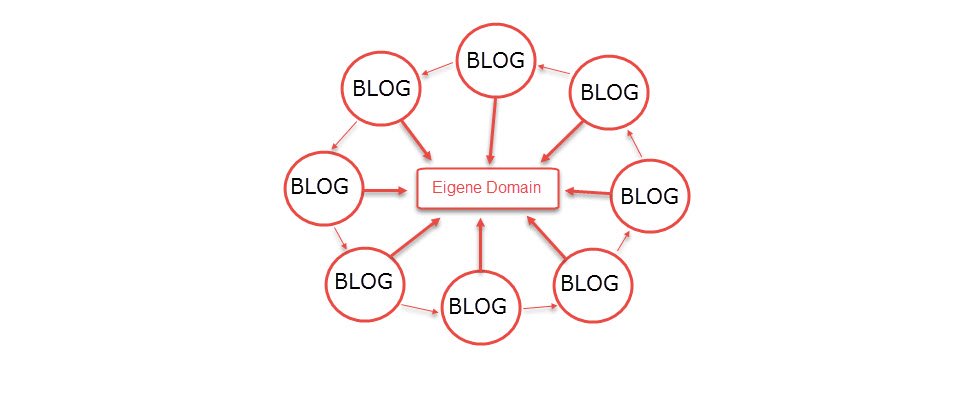

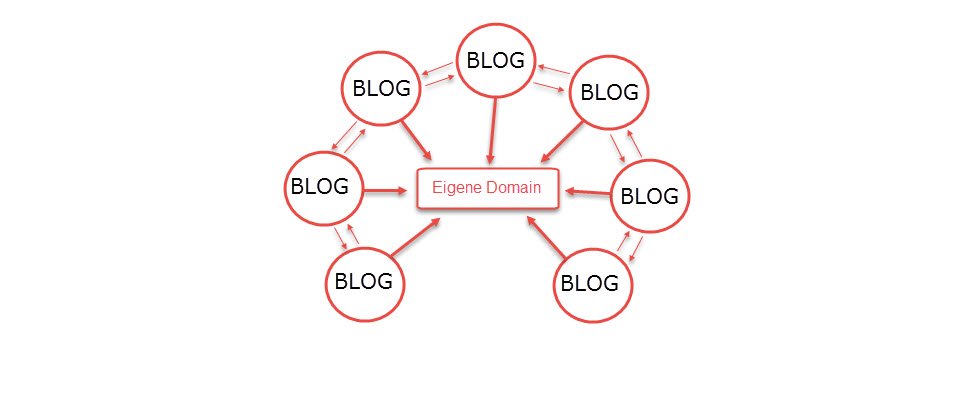

Spammige Websites auf demselben Webhoster sind einfach ein besonderer Fall von Kozitation, nur dass Sie mit spammigen oder sogar toxischen Websites kozitiert werden. Das kann passieren, wenn Sie in bezahlten Linknetzwerken, PBNs oder anderen künstlichen Linkmustern auf Einkaufstour gehen.

Für unser Link Detox haben wir schon 2012 nur ein paar grundlegende Regeln für Kozitationen und Netzwerke eingeführt. Damit fand Link Detox bereits so viele problematische und geradezu toxische Links (die zu Abstrafungen führten), dass wir überrascht waren, dass Google nicht schon früher als 2012 Maßnahmen gegen den (spammigen) Zustand des Link-Building ergriffen hat.

Beispiel für eine schlechte Nachbarschaft

Selbst wenn Sie nicht direkt auf spammige Seiten verlinken, haben Sie schon ein Problem – nämlich dann, wenn Sie auf Seiten verlinkt sind, die auch mit spammigen Websites oder anderen Linkkäufern verlinkt sind.

Das gilt auf Seiten-Ebene, wie in dem einfachen Beispiel des bezahlten Sunglasses-Links von der Linux-Site, die ich seit 2005 verwende, um schlechte Nachbarschaft zu erklären. Dasselbe gilt aber auch auf Domain-Ebene. Wenn Sie also Ihre Links in Beiträgen von Domains haben, auf denen eine Menge anderer Linkkäufer ihre Links haben, könnten Sie in Schwierigkeiten geraten.

Wer hat noch Links, wo Sie welche haben?

Seien Sie vorsichtig, wer MIT Ihnen verlinkt ist – jetzt und auch in Zukunft.

TrustRank zeigt, dass die Linkqualität relativ ist: Wenn Ihre Domain vertrauenswürdig ist, wird sie anders und schneller auf Links reagieren.

Sie sollten daher versuchen, TRUST und nicht nur LINKS aufzubauen!

Das funktioniert aber nicht, indem Sie einfach jedem Ihrer 300-Wörter-„High-Quality-LSI-Posts“ einen Wikipedia-Link aufdrücken.

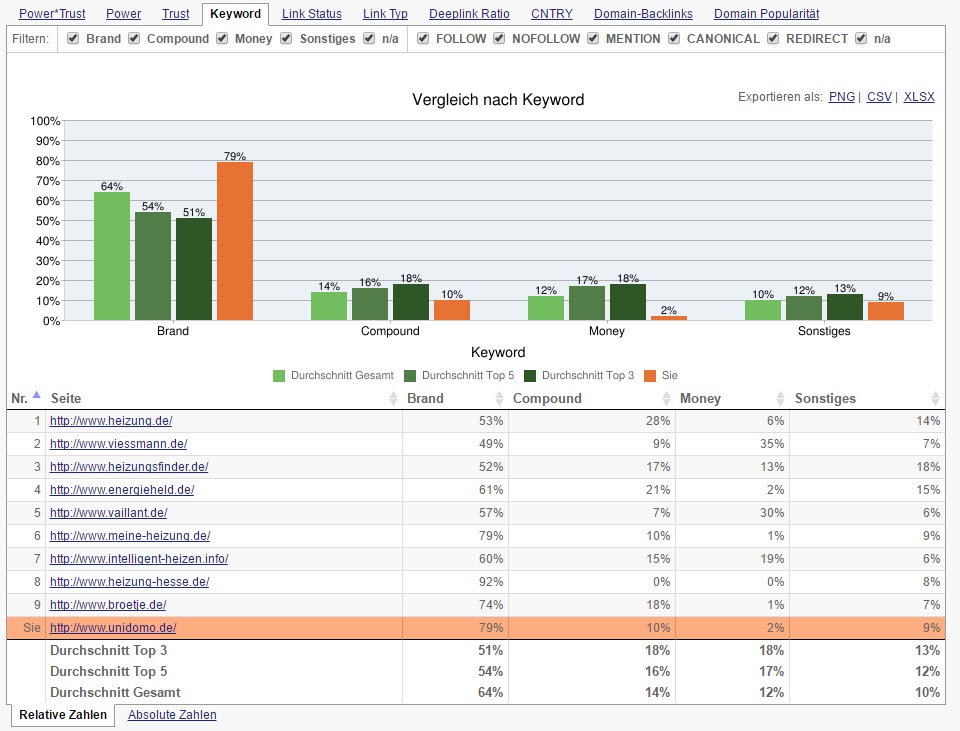

3. Verwenden Sie natürlichen Ankertext

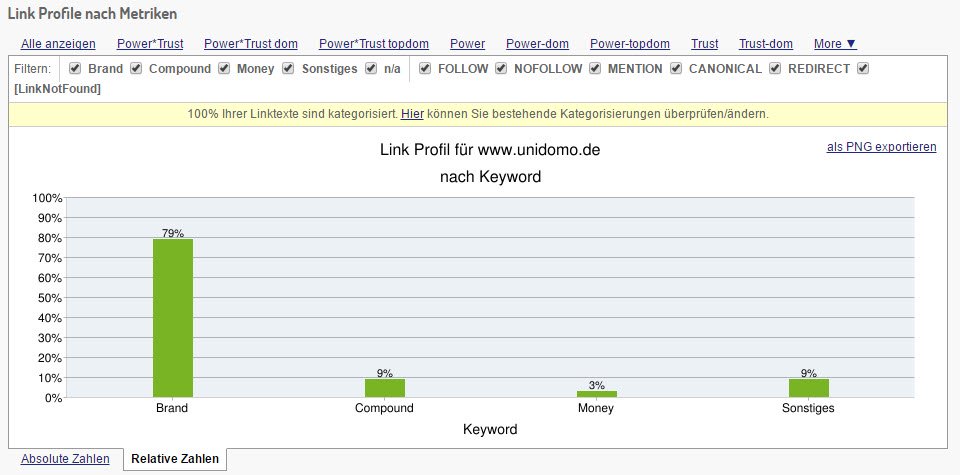

Natürliche Ankertextverteilung ist seit 2009 essenziell und ist es immer noch.

Bei den Google-Penguin-Abstrafungen haben wir so viele überoptimierte Link-Profile gesehen … mit all den Links für die Money-Keywords – es war ein heilloses Chaos. Aber auch heute noch entstehen viele Probleme dadurch, dass man es mit den Ankertexten übertreibt und immer wieder das gleiche Keyword verwendet.

Am besten und natürlichsten ist es, wenn jeder Ankertext nur einmal vorhanden ist. Die einzige Ausnahme können Ihr Markenname und Variationen davon sein, einschließlich Ihres Domainnamens.

Am besten denken Sie nicht zu sehr über die Ankertexte nach, denn sonst sehen Ihre Links nicht natürlich aus!

Die Besessenheit mit kommerziellen Ankertexten war schon 2009 falsch und ist es auch jetzt noch.

Abstraktes Beispiel für natürlichen Ankertext

Ein abstraktes Beispiel für eine natürliche Ankertextverteilung könnte so aussehen:

| Keyword | Vorhanden (in %) |

|---|---|

| [Markenname] | 27,0 % |

| [Markenname plus einige Dinge] | 19,0 % |

| [Schlüsselwort und Markenname plus einige Dinge] | 11,0 % |

| [Domain-Name] | 7,0 % |

| [Seltsames Schlüsselwort und einige Dinge] | 1,3 % |

| [Seltsames Schlüsselwort Nr. 2 und einige Dinge] | 1,2 % |

| [Merkwürdiges Schlüsselwort plus Money-Keyword und einige Dinge] | 1,1 % |

| [Money-Keyword] | 0,1 % |

Der Kontext der verlinkenden Seite, die verlinkte Seite und der Inhalt beider Inhalte ist natürlich wesentlich, heute mehr denn je.

Lassen Sie sich nicht von dem Gedanken täuschen, dass Sie nur „den richtigen Ankertext“ haben müssen; diese Zeiten sind vorbei. Trotzdem bleibt der Ankertext ein entscheidendes Element beim Linkaufbau und wenn Sie ihn auf Websites mit geringem Risiko beeinflussen können, dann tun Sie das.

Wir haben gesehen, wie übervorsichtige SEO-Teams ihre Links nur mit dem Markennamen und NULL Links mit der URL als Ankertext aufgebaut haben. In manchen Branchen ist das nicht genug. Relevante Keywords in Ihrem Linkprofil zu haben, ist nicht nur natürlich, sondern auch notwendig für gute Rankings.

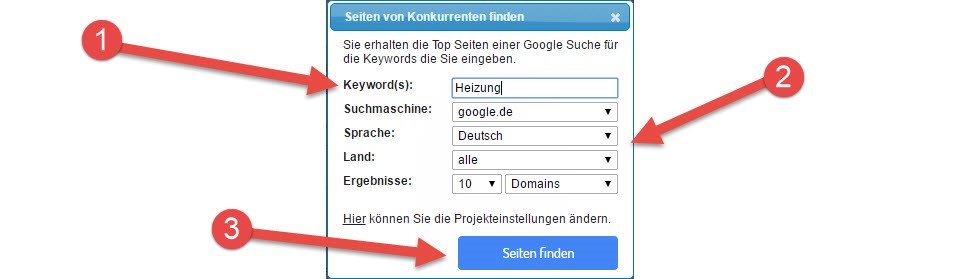

Die Regeln sind für jedes Land, jede Sprache, jede Branche, jedes Thema, jedes Unterthema und jede Keyword-Gruppe unterschiedlich.

Stellen Sie sicher, dass Sie Ihre Wettbewerbsrecherche durchführen, um die Regeln für Ihr Land, Ihre Sprache, Ihre Branche, Ihr Thema, Ihr Unterthema und Ihre Keyword-Gruppe zu ermitteln. Viele Menschen glauben, dass es ein einheitliches SEO-Regelwerk gibt, aber das ist ein Irrglaube.

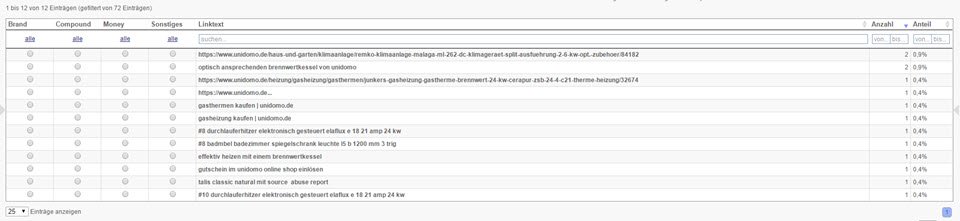

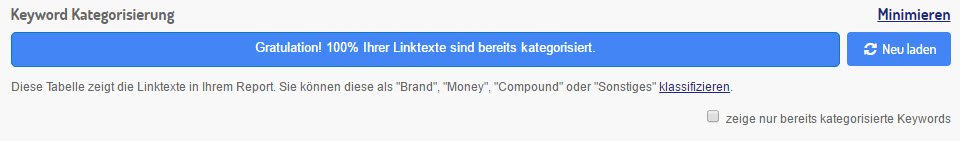

Erfahren Sie mehr über Keyword-Klassen wie Money-, Brand- und Compound-Keywords.

Was ist überhaupt ein natürlicher Link?

Ein natürlicher Link sieht so aus, als wäre er von einem Benutzer und nicht von einem SEO erstellt worden. Normale Benutzer interessieren sich nicht für Ankertexte, und wenn alle Ihre Links aussehen, als wären sie von einem SEO gemacht, haben Sie ein Problem!

Das bedeutet, dass Sie nicht nur hochwertige Money-Keywords in Ihren Links haben, sondern auch einige Links, die „coole Seite“, „Markenname X“, „hier klicken“ oder sogar eine längere Phrase enthalten.

Also: nicht über-optimieren!

Matt Cutts, der ehemalige Leiter der Web-Spam-Abteilung von Google hat es einmal ganz prägnant so ausgedrückt:

„Das Ziel ist nicht, Ihre Links natürlich erscheinen zu lassen –

das Ziel ist, dass Ihre Links natürlich sind.“

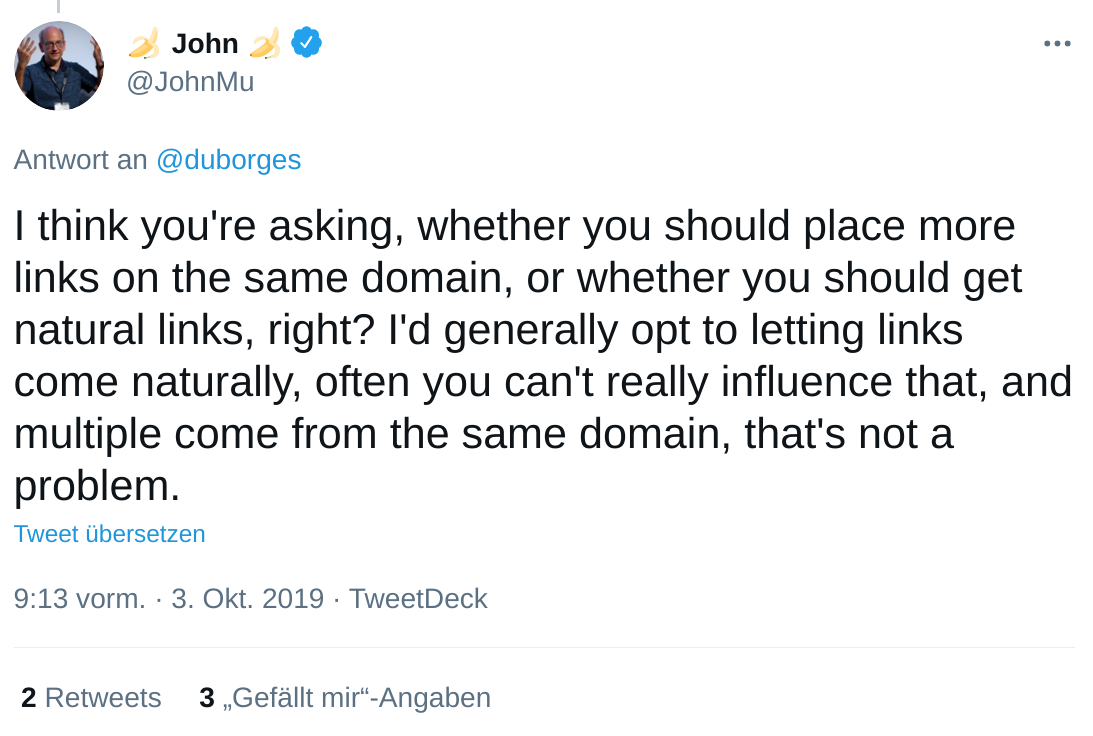

John Muller und Gary Illyes haben dies auf die eine oder andere Weise bestätigt:

4. Bauen Sie NoFollow-Links auf

Nehmen Sie einige NoFollow-Links in Ihr Linkprofil auf. NoFollow-Links sind natürlich.

Wenn Sie Links aufbauen, bauen Sie dann auch NoFollow-Links auf relevanten Seiten auf?

Natürlich tun Sie das! Zumindest hoffen wir es.

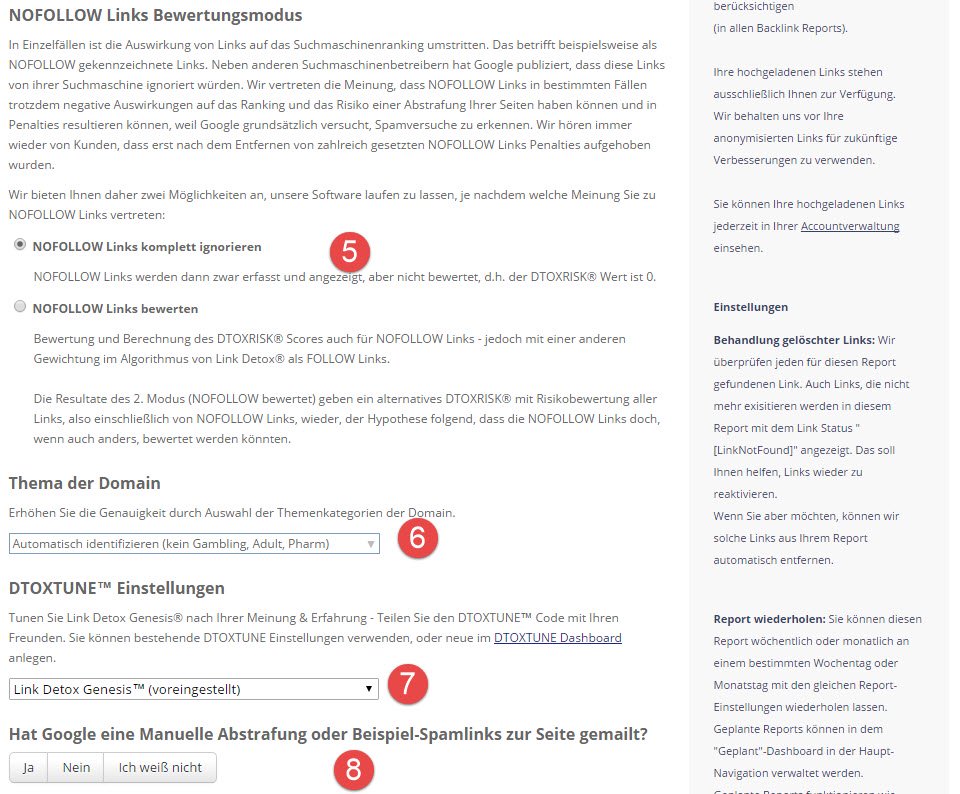

Wir empfehlen, den Aufbau, die Analyse, das Auditing und das Disavowen von (spammy) NoFollow-Links seit 2009 – und machen das für unsere Kunden seit 2005. Ja, Sie haben richtig gelesen – auch das Disavowen von toxischen NoFollow-Links hatte einen hilfreichen Effekt.

Warum das so ist? Ganz einfach: Normale Benutzer kümmern sich nicht um NoFollows-Tags. Und Sie sollten sich auch nicht um NoFollow-Tags kümmern – spätestens seit 2019.

Wenn Sie den Normalbürger fragen, was ein NoFollow-Link ist, wird er keine Ahnung haben, was das ist, und es wird ihn auch nicht interessieren – weil er es nicht muss.

Seien Sie kein Link-Builder, seien Sie der normale Mann oder die normale Frau im Internet, der/die Links setzt.

Ihre Links sollten so aussehen, als wären sie von normalen Nutzern aufgebaut worden, und deshalb sollten Sie auch NoFollow-Links einbauen.

Im Jahr 2019 folgte die offizielle Bestätigung von Google, dass sie NoFollow-Links zählen.

Na bitte, wir haben es immer schon gewusst.

Ich habe es bereits vor über 11 Jahren gesagt :)

5. Links auf „saftigen“ Seiten – Links mit Traffic

Seit 2009 sage ich den Leuten, dass sie „saftige“ Links aufbauen sollen.

Wenn eine Seite „saftig“ ist, bedeutet das, dass die Seite für verschiedene Keyword-Phrasen rankt und dass sie diesen Kontext an Sie weitergibt, wenn Sie einen Link darauf haben. Das funktioniert zwar auch unabhängig vom Ankertext, aber mit einem gezielten Ankertext noch besser. Eine Webseite, die für eine Phrase oder ein Schlüsselwort rankt, das für Sie wichtig ist, ist eine Seite, auf der Sie einen Link haben möchten, unabhängig vom PageRank oder sonstigen SEO-Tool-Metriken, die gerade in Mode sind.

Manche Leute nennen solche Links auch „Links mit Traffic“.

In unserer Zeit als Link-Building-Agentur (die wir 2012 geschlossen haben, um Interessenkonflikte zu vermeiden) haben wir eine einzigartige, sehr gründlich arbeitende „CEMPER Juice Metric“ entwickelt, die den „Saft“ einer Seite unabhängig von einem künstlichen Keyword- oder Sichtbarkeitsindex misst.

Heutzutage spricht man statt von „Links auf saftigen Seiten“, eher von „Links mit Traffic“, was lustig ist, weil es damit ja nicht gesagt ist, dass diese Links auch Traffic zum Ziel schicken.

Ein goldener Link bringt Ihnen „Verweisungs-Traffic von Links mit (organischem) Traffic“.

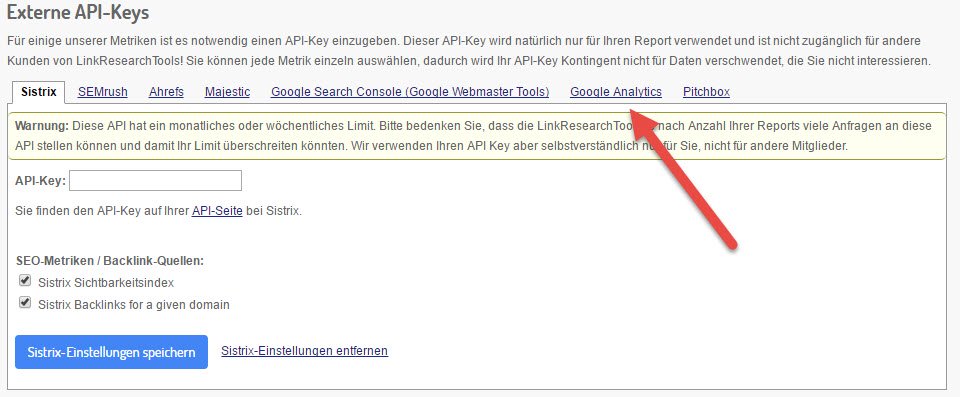

Das Video „Links mit Traffic“ geht auf die Definition ein und wie Sie Links mit Traffic finden können, sei es kostenlos oder mit bezahlten Tools wie Ahrefs, SEMrush, Sistrix und LRT.

Seien Sie sich bewusst, dass die meisten Leute „Link-Saft“ als Pagerank (oder Link-Power) bezeichnen, der weitergegeben wird (oder nicht). Dabei übersehen sie aber, dass es eigentlich um die Frage geht, wie viel Ranking-Power diese Seite wirklich hat.

Ich bin mir nicht sicher, wer vor langer Zeit den Begriff „Link Juice“ geprägt hat, aber es könnte mit der Erwähnung der „Saftigkeit“ von Seiten zu tun haben.

Sie wollen keine Links:

- auf Seiten mit doppeltem Inhalt (wie Artikelverzeichnissen und Artikelseiten)

- auf Webseiten, die Jahre alt sind, ohne ihren Inhalt zu ändern (im Jahr 2021 auch „Nischen-Edits“ genannt), denn diese sind höchst riskant und manchmal gehackte Websites

- in einer schlechten Nachbarschaft

- auf Websites, von denen bekannt ist, dass sie Links verkaufen

- auf von Google abgestraften Websites

- auf gehackten Websites oder Websites, die Malware verbreiten

Nach all diesen Jahren haben wir eine einfache Metrik entwickelt, um genau diese Aspekte abzudecken. Sie heißt LRT Risk.

Mit LRT Risk können Sie sogar Links prüfen, die Sie noch gar nicht haben. Verwenden Sie einfach den LRT Link Simulator, um das Risiko abzuschätzen und schon vorher zu erfahren, ob es sich lohnt, einen bestimmten Link aufzubauen.

7. Kaufen Sie keine Links für PageRank (oder DR oder DA)

Früher haben die Leute PageRank gekauft. Die Zeiten des Google-Toolbar-PageRank sind längst vorbei – aber die Denkweise hat sich gehalten.

Die Leute bewerten Links jetzt oft anhand von Metriken auf Domain-Ebene, etwa Ahrefs DR oder Moz DA. Das ist aber leider noch schlechter als Google PageRank.

Es ist schlicht Unsinn, eine einzelne Seite anhand von aggregierte Metriken einer ganzen Domain beurteilen zu wollen.

Eine solche Metrik ist viel zu allgemein, um etwas über die konkrete Seite auszusagen. Die Seite könnte eine nützliche Seite oder eine wertlose, verwaiste Seite ohne Link-Juice sein. Ohne die konkrete Seite zu prüfen, wissen wir es nicht.

Ich habe schon 2009 und davor davon abgeraten, Links nur für PageRank aufzubauen. Aber zumindest war PageRank eine Metrik auf Seitenebene.

Verwenden Sie nicht nur quantitative Metriken wie Ahrefs UR, Moz PA oder sogar LRT Power. Diese sind genau wie der alte PageRank, von dem ich schon 2009 abgeraten habe. Diese Metriken messen, vielleicht über eine logarithmische Skala, die Anzahl der Links oder Domains – und das können Millionen sein. Die bloße Zahl sagt aber nichts aus, denn es kann sein, dass Google all die Millionen Links einfach ignoriert und die Seite damit für uns als Link-Builder wertlos macht.

Nachwort

John Muller hat kürzlich bestätigt, dass es nicht auf die Anzahl der Links ankommt, sondern auf deren Qualität. Das war 2009 so und ist auch heute noch so. Ach ja, er hat das übrigens in einem orangefarbenen T-Shirt getan :) Ob das ein Zeichen ist?

SEO-Metriken, die sich nur auf die Anzahl der verweisenden Links oder verweisenden Domains konzentrieren, sind irreführend.

Die Gesamtzahl sei völlig irrelevant, sagte Muller.

Ich kann da nur beipflichten und möchte hinzufügen, dass dies besonders dann gilt, wenn keine anderen Messungen wie Traffic, Risiko oder Trust einbezogen werden.

Mit LRT können Sie sehr schwache Links erkennen, die aber einen hohen Trust haben. Das sind die Links, die Sie behalten sollten. Nur weil ein Link aufgrund seines „Link-Graphen“ und der „Anzahl der verweisenden Domains“ schwach aussieht, sagt das noch nichts über seine wirkliche Power aus. Leider behaupten einige SEO-Experten, dass schwache Links schlecht sind, vielleicht sogar disavowt werden müssen. Dies ist nach unserer Erfahrung nur dann notwendig, wenn diese Links ein hohes Risiko und überhaupt keinen Trust haben.

Wenn Sie sich Metriken auf Seitenebene ansehen, empfehlen wir die Verwendung des LRT Page Trust; dieser erbt den Domain Trust, wenn die Seite gut verlinkt ist.

TL:DR und praktische Ratschläge

Ihr Schreibtisch ist voll und Sie haben nicht die Zeit, lange Artikel zu lesen? Kein Problem, hier kommt Ihre TL:DR mit praktisch umsetzbaren Ratschlägen.

- Verwenden Sie keine domainbasierten Metriken wie Ahrefs DR oder Moz DA zur Qualifizierung und Bewertung von Links. Das sind Wohlfühl-SEO-Metriken ohne echten Nährwert.

- Planen Sie lieber eine gewisse Zeit ein, um konzentriert die Goldenen Regeln des Link-Building zu lesen und sie zu verinnerlichen. Die Rankings Ihrer Kunden werden es Ihnen danken.

Auf Ihren Erfolg!

Christoph C. Cemper

Ich wache jeden Tag auf und denke über Links nach.

PS: Sie können die Spam-Beispiele, die uns die Google-Spam-Ingenieure gezeigt haben, kostenlos erhalten – klicken Sie dazu einfach auf die folgende Schaltfläche.

Besonderer Dank

Einige Leute haben überdurchschnittlich dazu beigetragen, diesen Beitrag noch besser zu machen. Mein herzlicher Dank gilt:

- Jake Sacino, der auf https://webpop.io schreibt und in der Agentur Ranked.net.au arbeitet, für das fantastische, umfassende Feedback zum gesamten Beitrag, den lustigen Penner-Satz, der mich als Lead-Out zum Lachen brachte, und so viele andere tolle Dinge, die diesen Beitrag verbessert haben.

- Ammon Johns für ultra-nützliche und dichte Erklärungen über das Web und Facebook im Allgemeinen, und sein konstruktives Beispiel für Relevanz (das es in diesen Beitrag geschafft hat, während ich so viele weitere hatte, von ich nur einen Screenshot machen konnte).

- Lyndon NA (Darth Autocrat) dafür, dass er mir Feedback, Ideen und extrem umfassende Twitter-Threads als Antwort auf so viele Gedanken gibt, die ich dort poste. Es besteht eine hohe Wahrscheinlichkeit, dass er mich in vielerlei Hinsicht beeinflusst hat, z. B. mich aufzuraffen und diesen Beitrag doch wirklich (wieder) zu schreiben.

- Jim Boykin von Internet Marketing Ninjas, eine der wahren Legenden im Link-Building. Vielen Dank für so vieles, angefangen mit einem Tag in Yosemite im Jahr 2005, an dem ich viel zu viel für einen Tag von ihm gelernt habe.

Anhang

„Prähistorische“ Beiträge und Videos zu den Regeln des Link-Building

- Originaler Blogpost „The 7 Golden Rules of White Hat Link Building“ von 2009 im Webarchiv

- die zum Post gehördenen Ursprungsfolien auf Slideshare vom Mai 2009

SEO Poll: Relevanz von Links

Umfragen auf Twitter und Facebook ergeben unterschiedliche Meinungen und Definitionen zur Relevanz von Links.

Fußnoten

* wenn Sie genau aussehende Zahlen sehen, dann ist das manchmal ein „Werbetexter-Trick“ aus der Welt des Direktmarketings der 60er Jahre. Die Zahlen sollen den Leser dazu verleiten, eine sehr hohe Präzision und Vertrauenswürdigkeit anzunehmen. Das Gegenteil ist oft der Fall, wie Sie an Betreffzeilen wie **So habe ich mit nur 1,5 Stunden Arbeit 123.544,52 Euro verdient** erkennen können. Die Zahlen sind wahrscheinlich frei erfunden, haben aber die Konversionsrate jahrzehntelang erhöht. Hier sind einige gute Beiträge von Copyblogger oder Persuasion at work zu diesem Thema.

Der Stand dieses Posts

Hinweis: Sie lesen eine Entwurfsversion mit nur 7.082 Wörtern; weitere Wörter werden hinzukommen.

Noch TODO:

- [ ] weitere Beispiele hinzufügen

- [ ] weitere Links hinzufügen

- [ ] Rezension

- [ ] Korrekturlesen

- [ ] Layout

- [ ] Übersetzung

PS: … und ich denke auch jeden Tag darüber nach, wie man am besten alle Linkdaten aus allen Datenquellen da draußen kombiniert, um den goldenen Link zu finden, der manchmal am LRT-Baum wächst :-)

Arbeiten Sie mit einer Kombination aus mehr als 25 Linkdatenquellen

Nutzen Sie genaue, zuverlässige und frische Linkdaten mit nur einem System - LinkResearchTools.

Keine andere SEO-Software und kein Online-Marketingtool kann Ihnen etwas Gleichwertiges bieten. So maximieren wir die Abdeckung des Backlink-Profils für Sie.

Schon gewusst? Andere Produkte liefern Ihnen Daten, die zuletzt vor bis zu 5 (!) Jahren gecrawlt wurden.

Würden Sie mit alten und unvollständigen Daten arbeiten wollen? Oder doch lieber LinkResearchTools verwenden?

Als SEOs ist das Link-Building ohne Zweifel eines der mächtigsten Werkzeuge, die uns zur Verfügung stehen. Bauen Sie gute Links auf, und die Websites Ihrer Kunden werden im Ranking entsprechend nach oben klettern. Zufriedener Kunde :)

Trotzdem wird das Link-Building immer schwieriger, und Google ändert seine Algorithmen ständig. Als SEO-Profis müssen wir auf dem Laufenden bleiben und immer auf dem neuesten Stand sein, was den Kern des Link-Building angeht: die Metriken.

Um Sie bei Ihren Bemühungen zu unterstützen, habe ich eine Liste mit den vier wichtigsten Metriken zusammengestellt, die wir überprüfen müssen, um die begehrten „juicy“ Links für unsere Kunden aufzubauen und der Konkurrenz immer voraus zu sein. Also, auf geht's!

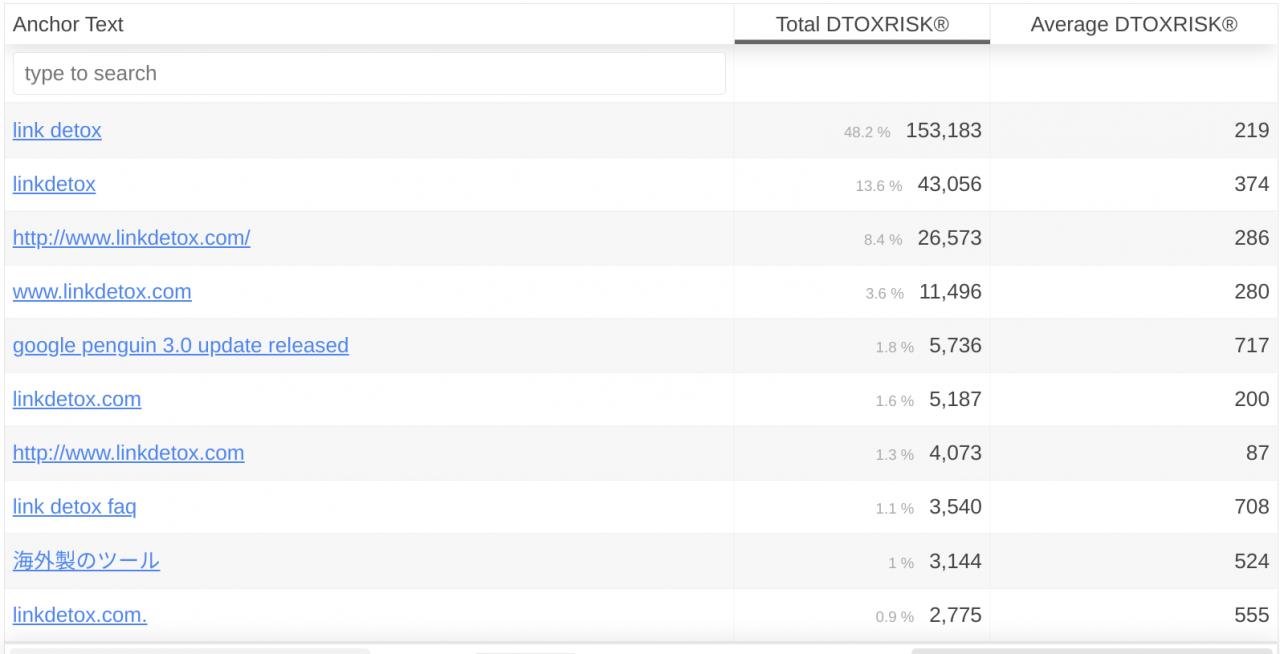

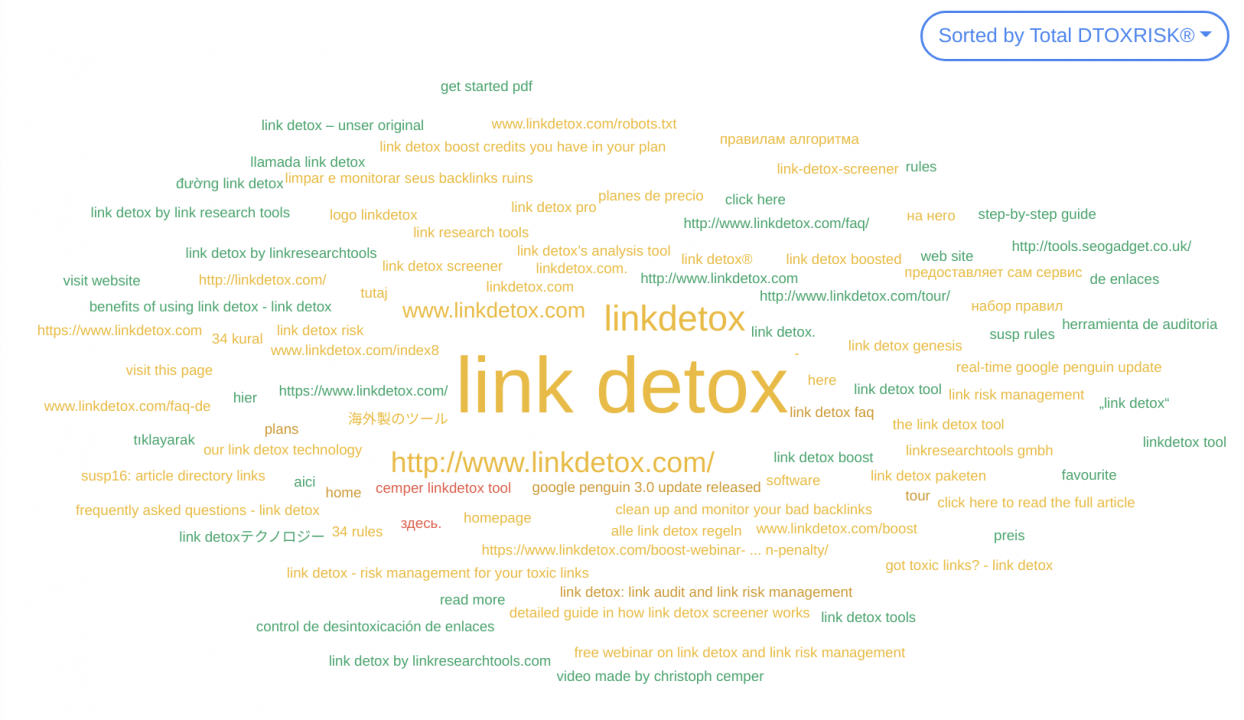

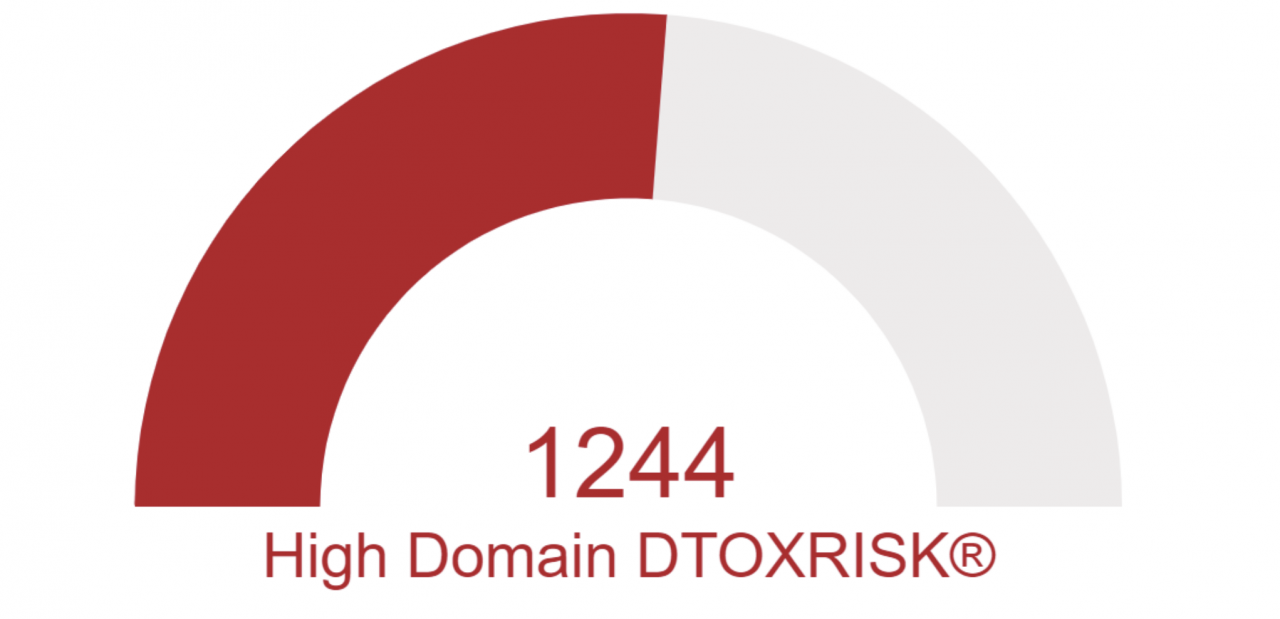

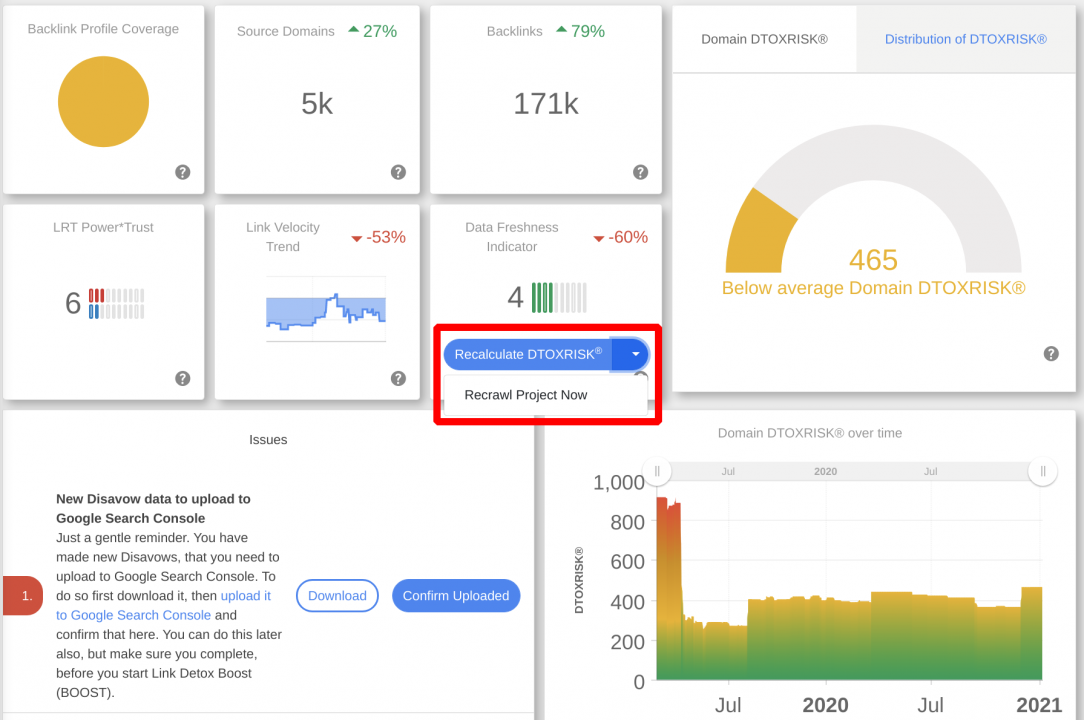

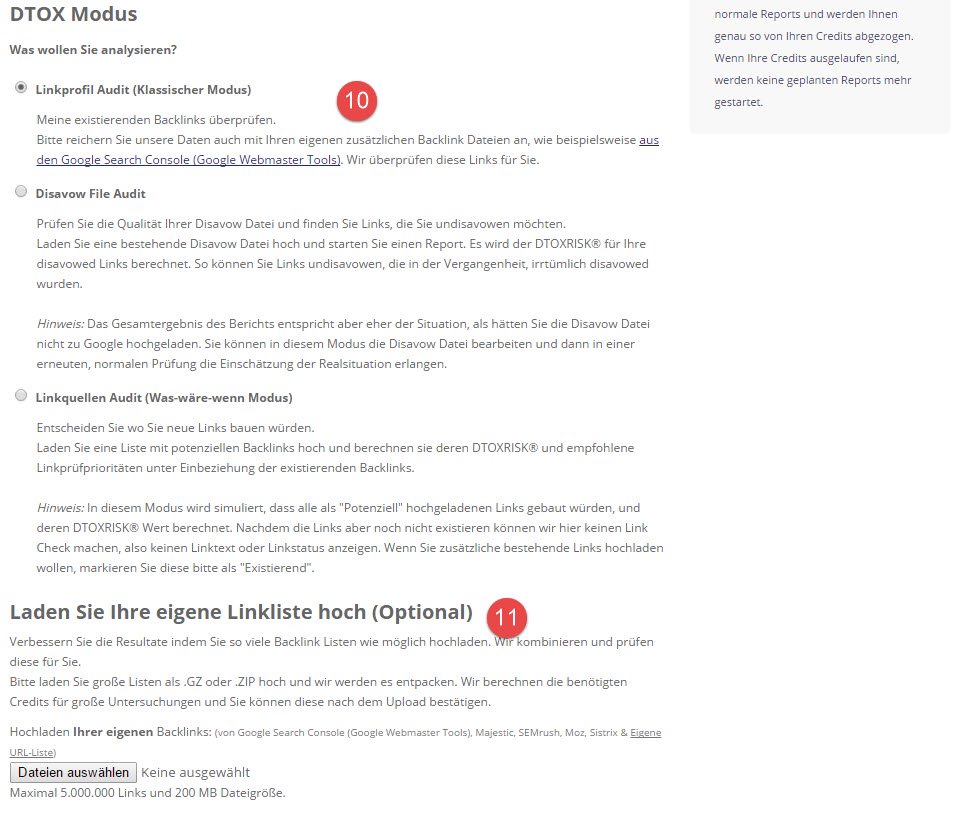

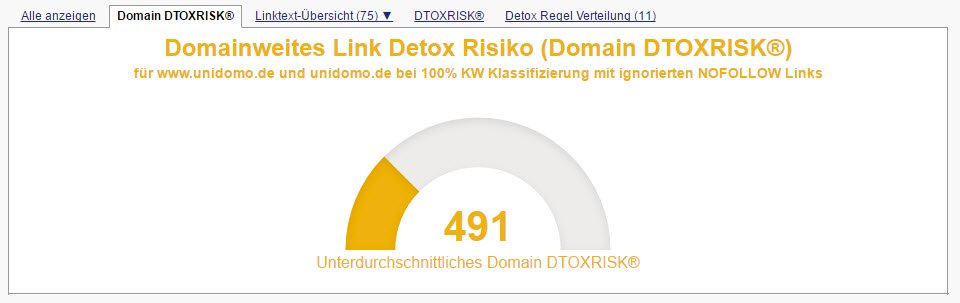

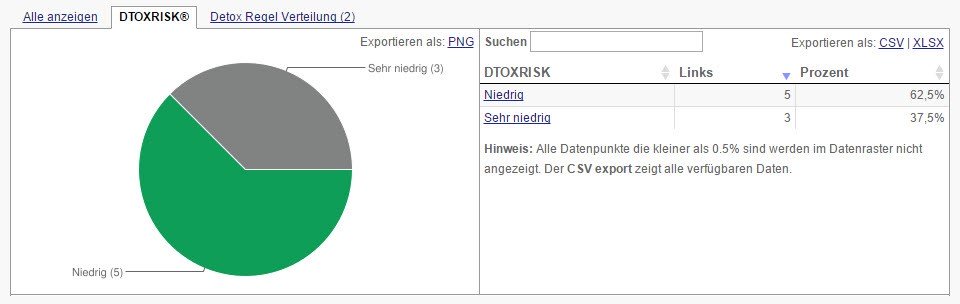

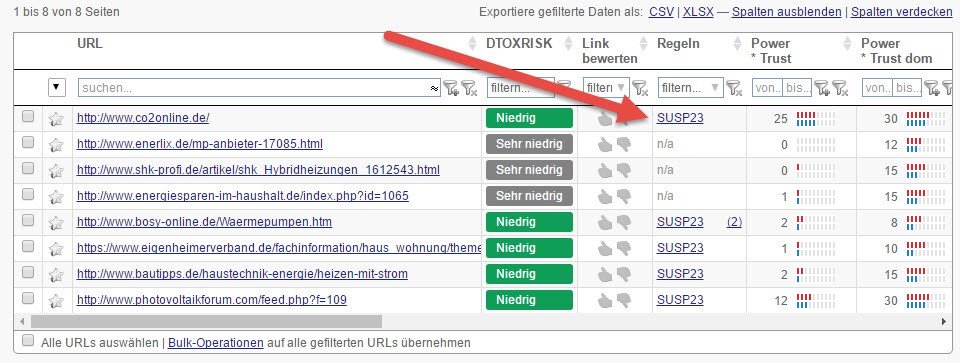

1. Link Detox Risk

Link Detox Risk ist eine einzigartige Metrik von LinkResearchTools (LRT). Die Metrik nutzt automatisierte Regeln, um das Risiko zu berechnen, dass ein Link (oder eine Website) Ziel einer Google-Abstrafung wird.

Warum sollte man Link Detox Risk verwenden und nicht nur die berühmte Metrik „DR“ (kurz für „Domain Rating“) in Ahrefs? Die Antwort ist einfach: Beide sind nicht dasselbe und DR ist bei weitem nicht so effektiv als Link-Building-Tool wie Link Detox Risk es ist. Hier ist der Grund dafür:

DR basiert oft auf alten Crawl-Daten. Ahrefs DR, wie auch Moz DA, messen eine ganze Domain, indem sie Metriken für Seiten sammeln und einen Durchschnitt berechnen.

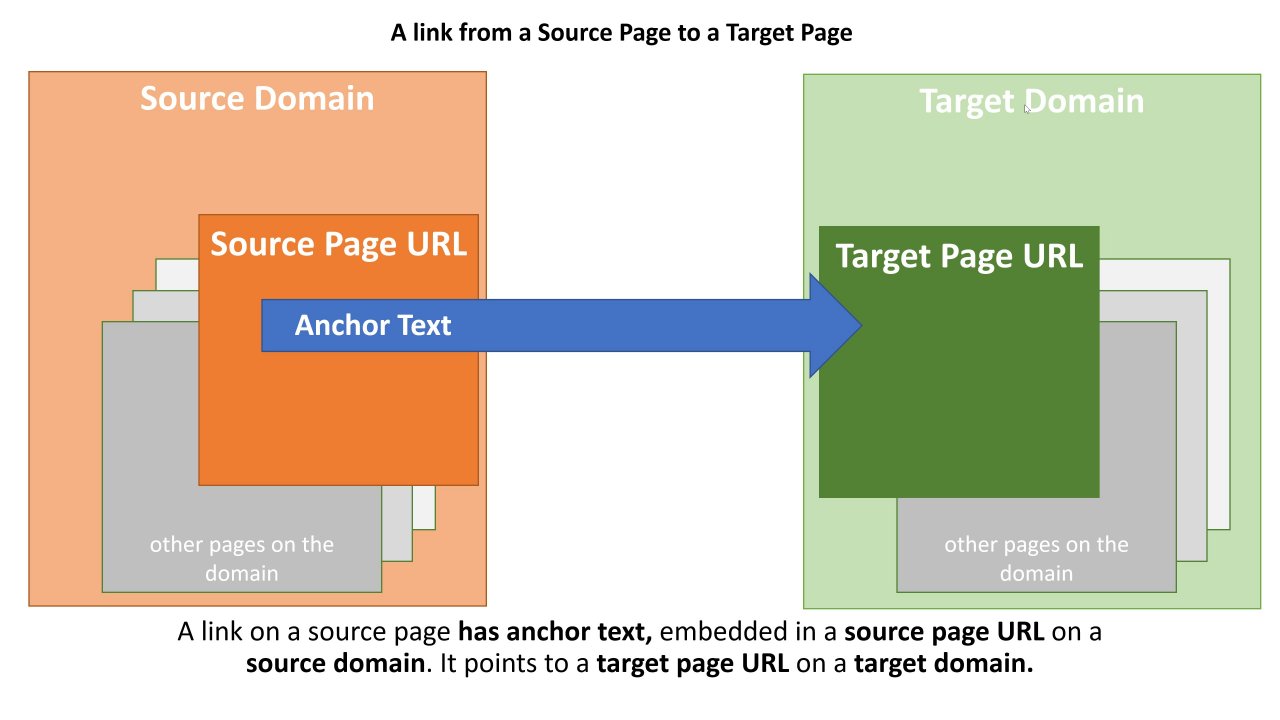

Links müssen allerdings auf Seitenebene gemessen werden. Ein Link ist eine Verbindung von einer Seite zu einer anderen, nicht von einer Domain zu einer anderen Domain. Eine Domain ist nur eine Ansammlung von Seiten mit Links.

Einfach ausgedrückt: Sie können eine Seite nicht nach domainbasierten Metriken beurteilen. Sogar Google selbst hat bestätigt, dass man dort keine domainweiten Metriken hat. Auch der Sistrix SI (Sichtbarkeitsindex) ist nur ein Maß für die Rankings der gesamten Domain.

Es ist zwar grundsätzlich interessant zu wissen, ob eine Domain Rankings hat, oder nicht - aber für das Link ist diese Erkenntnis nicht ausreichend. Wir zeigen in LRT z.B. die Rankings der gesamten Domain in der "Ranking Keywords" Metrik an.

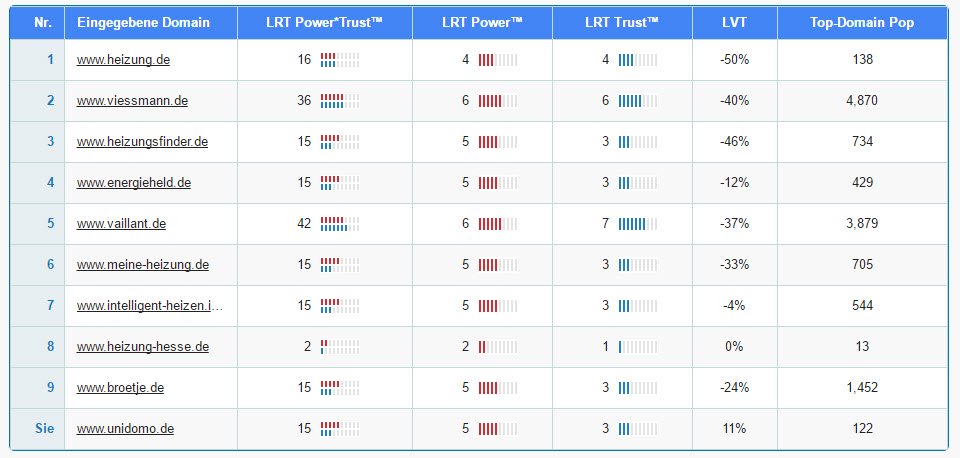

2. Link Trust

Um hochwertige Links aufzubauen, müssen die Links in den „algorithmischen Augen“ von Google vertrauenswürdig sein. Dieses Vertrauen ist nicht leicht zu bekommen. Das Vertrauen wird von der Quellseite Ihrer Links vererbt. Je mehr Vertrauen eine Quellseite genießt, desto mehr Vertrauen überträgt sie auf die Zielseite, also die Seite, für die Sie die Links aufbauen.

Um den Trust einer Quellwebsite zu messen, verfügt LRT über eine Metrik namens „LRT Trust“, die in Ahrefs und SEMrush nicht verfügbar ist.

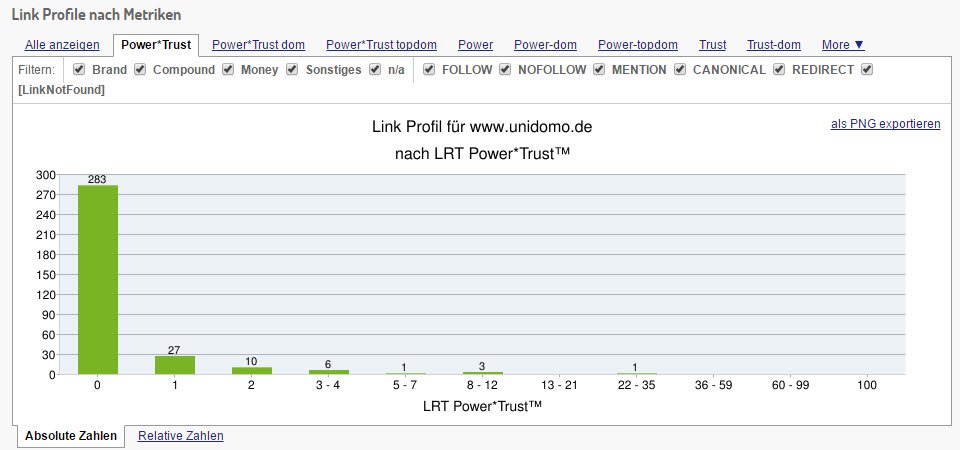

3. Link Power

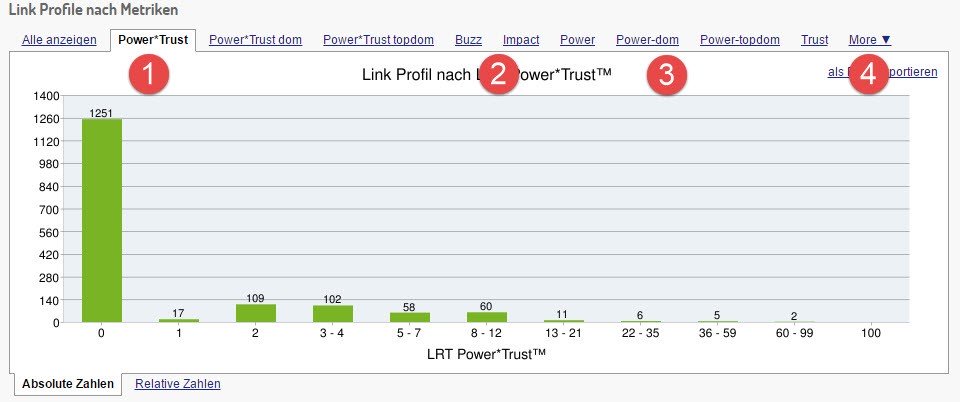

Link Power ist die zweite Säule des zweidimensionalen Messsystems der Link-Qualität bei LRT. „Link Power“ ist dem früheren Google Page Rank oder dem UR-Rating in Ahrefs etwas ähnlich und misst die Power einer Website. Diese Link-Power entscheidet in Verbindung mit dem Link-Trust über die Qualität des Links, den Sie aufbauen wollen.

Wenn Sie nur auf eine Power-Metrik schauen (dazu gehört auch Ahrefs UR), dann verpassen Sie etwas.

Bitte beachten Sie, dass nur LRT Ihnen die Daten für Trust und Power (oder eine Kombination aus beidem) der Links präsentiert. Mit diesen Daten können Sie unsere Trust-und-Power-Matrix nutzen, die Ihnen die Entscheidung über Links erleichtert. Wenn Sie einen Link mit geringer Power und geringem Trust haben, ist er schwach und Ihre Zeit nicht wert.

Ein Link mit hoher Power aber geringem Trust nennen wir „Nitro“. Solche „Nitro“-Links müssen Sie sorgfältig überprüfen, damit ihre übermäßige Power nicht nach hinten losgeht. Auf der anderen Seite ist ein Link mit geringer Power, aber hohem Trust ein „High Potential“-Link und kommt auf Ihre Watchlist. Was Sie wirklich suchen, sind die „Awesome Superstars“, wie wir sie bei LRT nennen.

Diese Superstar-Links haben einen hohen Trust und eine hohe Power, was sie zu einer optimalen Ergänzung für Ihr Backlink-Profil macht.

Wie können Sie Linkstärke, Linkvertrauen (Trust) und Linkrisiko schnell und effektiv messen?

Der beste Weg, diese Metriken einfach und effektiv zu messen, ist unser LRT Link Simulator. Der Simulator zeigt Ihnen das Link-Detox-Risiko (sehr wichtig, um Google-Abstrafungen zu vermeiden), die LRT Power und den LRT Trust an.

Außerdem können Sie es nicht nur für Ihre bestehenden Links verwenden, sondern auch für Links, die Sie noch nicht haben. Das macht das Tool unglaublich wertvoll für die SEO-Arbeit. Sie können damit Links schon vor dem Aufbau prüfen und so mögliche Probleme vermeiden, bevor sie überhaupt entstehen.

4. Ankertexte

Der Text, der angezeigt wird, wenn Sie auf einen Link klicken, wird als Ankertext bezeichnet.

<a href="https://smart.linkresearchtools.com">Bestes Link-Tool</a>Im obigen Beispiel ist die Phrase „Bestes Link-Tool“ der Ankertext. Und es handelt sich zugleich um ein Money-Keyword. Die Verwaltung verschiedener Schlüsselwort-Klassifizierungen ist eine Kernfunktion von LRT. Sie werden in anderen Artikeln erfahren, warum es so wichtig ist, Keyword-Klassen zu verwenden und sich um die Vielfalt der Ankertexte zu kümmern.

Schließlich müssen Sie auch auf die Ankertexte Ihrer Links achten. Da es sich um den klickbaren Text in Ihren Links handelt, scannt Google diese Texte, um zu beurteilen, ob Ihre Website relevant ist oder ein „Spam-Monster“, das man besser ignoriert.

Denken Sie auch daran, wie wichtig die Relevanz Ihrer Links, der Ankertext und der umgebende Kontext sind. Das Thema Linkrelevanz werden wir hier noch einmal gesondert und unabhängig von den technischen SEO-Metriken vorstellen.

Fazit

Nun, ich hoffe, dass dieser kleine Überblick interessant für Sie war. Die Konzentration auf die vier oben genannten Metriken (Link Detox Risk, LRT Trust, LRT Power und Ankertexte) wird Ihre SEO garantiert auf die nächste Stufe bringen.

Haben Sie sich gewundert, dass wir nicht mehr zu den allgemeinen Lieblings-SEO-Metriken wie Ahrefs DR, Sistrix SI und Moz DA geschrieben haben? Nun, vielleicht liegt das daran, dass wir glauben, dass sie irreführender sind, als viele meinen. Aber keine Sorge, wir werden noch einen detaillierteren Vergleich über alles da draußen bringen und erklären, ob und unter welchen Bedingungen die Metriken zusätzlich zu den LRT-Kernmetriken noch nützlich sein können.

Wir haben zudem weitere Metriken, mit denen Sie zum Beispiel abgelaufene Linknetzwerke (PBNs) mit nur einer Metrik identifizieren können. Aber das ist ein Thema für einen anderen Beitrag.

Video über Link-Building-Metriken

Dieses Video war die Grundlage für diesen Beitrag und bietet noch viel mehr Details sowie praktische Beispiele. Schauen Sie doch mal rein!

Fragen Sie sich auch, welches das beste Verhältnis von DoFollow- zu NoFollow-Links ist?

Vielleicht fragen Sie sich das, weil das von Ihnen genutzte, „führende“ SEO-Tool Ihnen eine bestimmte Zahl anzeigt.

Dieser Beitrag gibt Ihnen einige Antworten, vor allem aber weitere Fragen, die Sie sich stellen müssen, wenn Sie SEO ernst(er) nehmen.

Falls Sie nicht bereit sind, mehr und bessere Fragen zu stellen, ist die Antwort auf die Frage nach dem besten Verhältnis einfach.

Sie lautet „42“ (also wie die berühmte Antwort in „Per Anhalter durch die Galaxis“) und Sie können hier mit dem Lesen aufhören.

Wenn Sie sich aber als SEO-Profi verstehen, der weiter wachsen will, lade ich Sie ein, mit mir tiefer in das Thema einzusteigen.

Zunächst müssen wir ein Missverständnis ausräumen: Manch einer glaubt, dass das NoFollow-Attribut heute keine Rolle mehr spielt, weil Google ja NoFollow 2.0 eingeführt hat.

Wenn Sie zu diesem Kreis gehören, ist das nicht schlimm. Lesen Sie einfach zuerst den verlinkten Artikel und dann hier weiter.

Es gibt kein „bestes Verhältnis zwischen Follow- und NoFollow-Links“!

Das Verhältnis zwischen bestimmten einzelnen Link-Attributen war in der SEO und Link-Analyse schon immer eine spannende Frage.

Es ist jedoch sinnlos, einfach nur eine möglichst große Zahl für alle Links in einer Linkdatenbank (Warnung: wahrscheinlich nicht das komplette Backlink-Profil) erreichen zu wollen.

Der Grund dafür liegt auf der Hand.

Wenn Sie das Web durchsuchen, finden Sie Beiträge, die fast 20 Jahre alt sind, und selbst bekannte Marken wie Moz machen immer wieder den Fehler, immer wieder die gleichen falschen Ratschläge zu geben und zu veröffentlichen.

Verhältniswerte von der Stange. Verallgemeinerte SEO-Regeln.

Wenn Sie ein teures „SEO-Training“ buchen, gibt man Ihnen dort wahrscheinlich eine allgemeine Empfehlung, sagen wir, „70 % Follow zu 30 % NoFollow“. So eine Empfehlung ist schlicht unsinnig, wenn nicht gar gefährlich!

Alle diese „Empfehlungen“ haben nämlich keine allgemeine Geltung, sondern treffen nur auf den speziellen Fall zu, den die ursprünglichen Autoren untersucht und genannt haben.

Die Wahrheit ist: „Es gibt kein allgemeingültiges Verhältnis von Follow- zu NoFollow-Links“.

Worauf es wirklich ankommt, ist die konkrete Situation in Ihrem Wettbewerbsumfeld.

Was zählt ist, wie Websites, die mit Ihnen konkurrieren, aussehen, wie sie verlinken, wie sie schreiben, wie sie sich verhalten und so weiter.

Wer glaubt, diese komplexe Betrachtung mit einer einfachen Daumenregel umgehen zu können, der glaubt vermutlich auch an die Antwort „42“ und kann mit dem Lesen aufhören. Wenn Sie aber bereit sind, Ihr SEO weiter zu verbessern, dann lassen Sie uns die Büchse der Pandora öffnen und den Dingen auf den Grund gehen.

Es gibt kein Website-weites Verhältnis von Follow- und NoFollow-Links

Wenn Sie sich Ihre Website ansehen, finden Sie dort wahrscheinlich eine Reihe von verschiedenen Bereichen und Themen.

Jedes dieser Themen oder jede dieser Keyword-Gruppen hat unterschiedliche SERPs.

Das bedeutet, dass für jedes dieser Themen oder jede dieser Keyword-Gruppen andere Regeln gelten!

Lassen Sie das auf sich wirken.

Je nach Art der Suchanfrage und je nach Suchintention haben Sie unterschiedliche Wettbewerber für Ihre Website.

Das bedeutet, dass Sie die Dinge etwas differenzierter betrachten müssen und sich nicht einfach auf die gesamte Website stützen können.

Es kann sein, dass Sie für ein Thema sehr gut ranken, aber für ein anderes Thema nicht so gut.

Das ist ganz natürlich. Was sagt das über Ihre Website aus?

NICHTS.

Welche der Follow- und NoFollow-Links sind disavowt?

Wenn Sie das Verhältnis eines einzelnen Link-Attributs (wie etwa das NoFollow-Attribut) betrachten, dürfen Sie andere beeinflussende Merkmale nicht vergessen.

In diesem Fall ist das Disavow-Attribut für die Bewertung von zentraler Bedeutung. Schließlich werden Links mit einem Disavow gar nicht gezählt. Was die Zählung von NoFollow-Links angeht, so haben sich die Regeln mit NoFollow 2.0 auch offiziell geändert.

Fragen Sie sich dazu:

Was hilft es, wenn man die Quote von 40 % Follow-Links kennt, aber die Hälfte dieser Follow-Links disavowt ist?

Was ist ein Verhältnis von 70 % NoFollow-Links wert, wenn die Hälfte dieser 70 % disavowt ist?

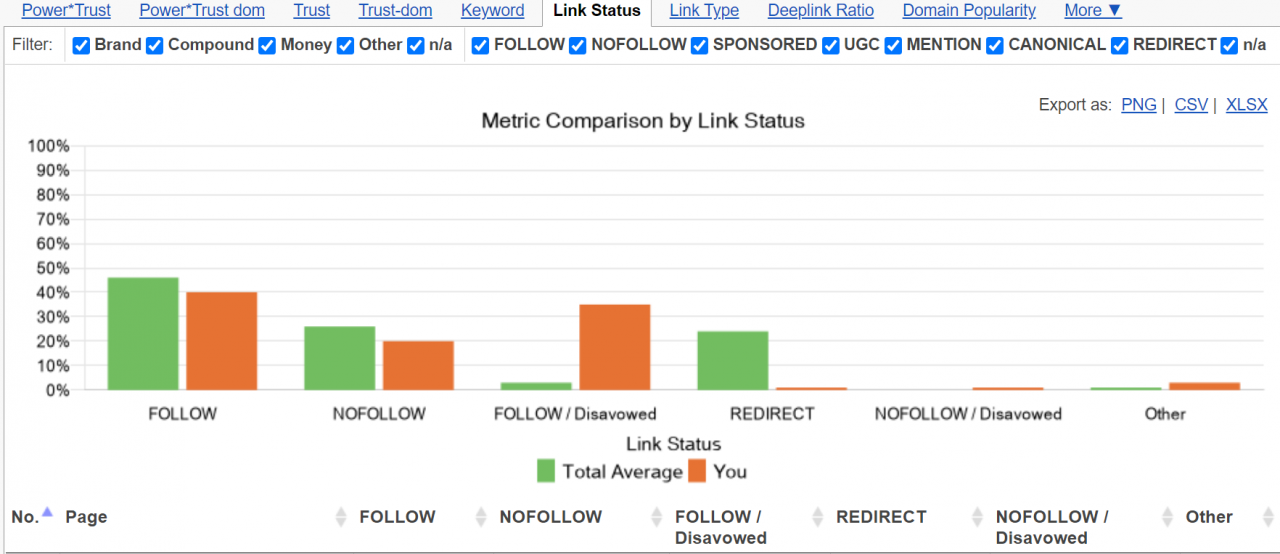

In dieser einfachen Übersichtsgrafik des Competitive Landscape Analyzer (CLA) sehen Sie, was ich meine … eine massive Anzahl eigener Follow-Links sind hier disavowt.

Welche Art von NoFollow?

Wussten Sie, dass Google jetzt zwischen drei verschiedene Arten von NoFollow-Links unterscheidet?

Wenn nicht, dann finden Sie neuen NoFollow-Attributen.

Webseiten haben ein Ranking, nicht die Website

Wichtig zu wissen ist, dass die einzelnen Webseiten ranken, nicht die Website an sich.

SEO spielt sich letztlich auf Seiten für Keywords ab, mit Links zu diesen Seiten, wobei die Links wiederum Keywords enthalten.

Die Domain ist nur eine Ansammlung von all dem.

Das Messen des SEO-Erfolgs anhand einer globalen, domainweiten Metrik ist eine grobe Vereinfachung, wie ich im folgenden Video erkläre:

Die Regeln sind unterschiedlich …

Die Regeln im SEO sind unterschiedlich, je nach:

- Land

- Sprache

- Branche

- Thema

- Keyword (Cluster)

- Ihrem Wettbewerb

Halten wir die wesentlichen Dimensionen, die wir gefunden haben, einmal fest:

NoFollow-Verhältnis in Bezug auf Themen, Keywords und mehr …

Wenn Sie akzeptieren, dass Sie eine Reihe von Keyword-Gruppen haben, die Sie optimieren können oder dass Sie zumindest ein anderes Thema wählen können, wird das Ganze interessanter.

Nehmen wir beispielsweise an, dass Sie drei Themen auf Ihrer Website haben:

- Thema 1 - NoFollow-Anteil 30 %

- Thema 2 - NoFollow-Anteil 90 %

- Thema 3 - NoFollow-Anteil 50 %

Ist das unrealistisch?

Nein, das ist ganz natürlich.

Wenn Sie bei der Prüfung dann nur auf den Gesamtdurchschnitt achten, sehen Sie einen NoFollow-Anteil von 56 % (unter der Annahme, dass alle drei Themen im Backlink-Profil gleich verteilt sind).

Was folgt daraus? Richtig, nur eines der drei Themen ist auch nur ansatzweise zutreffend dargestellt.

Sehen Sie, worauf ich hinaus will? Man braucht mehr als nur eine Zahl, um belastbare Schlussfolgerungen ziehen zu können.

Beispiel für ein themen-/keyword-basiertes NoFollow-Verhältnis

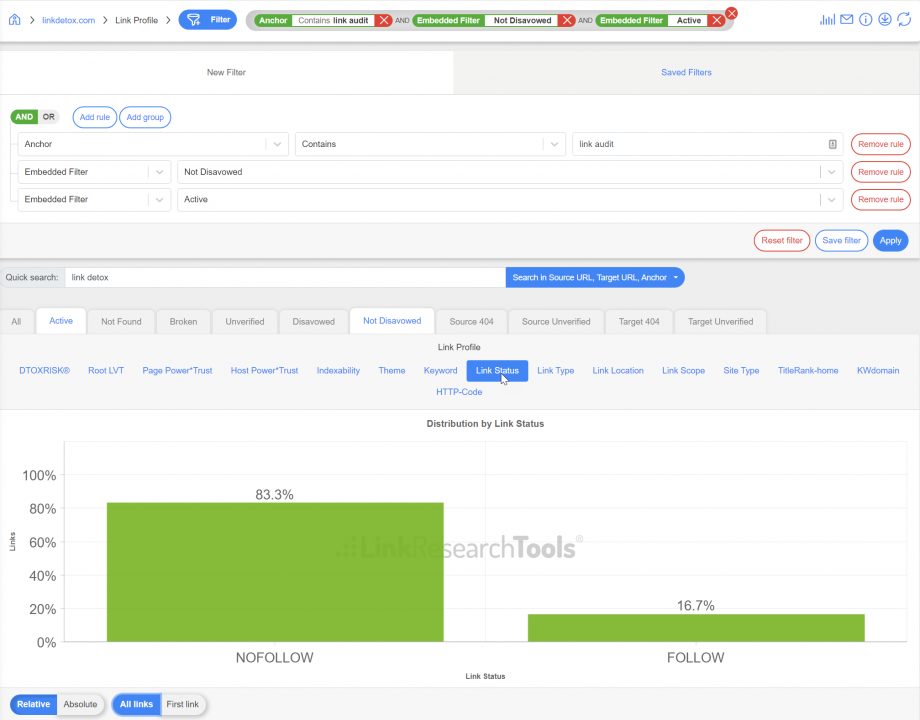

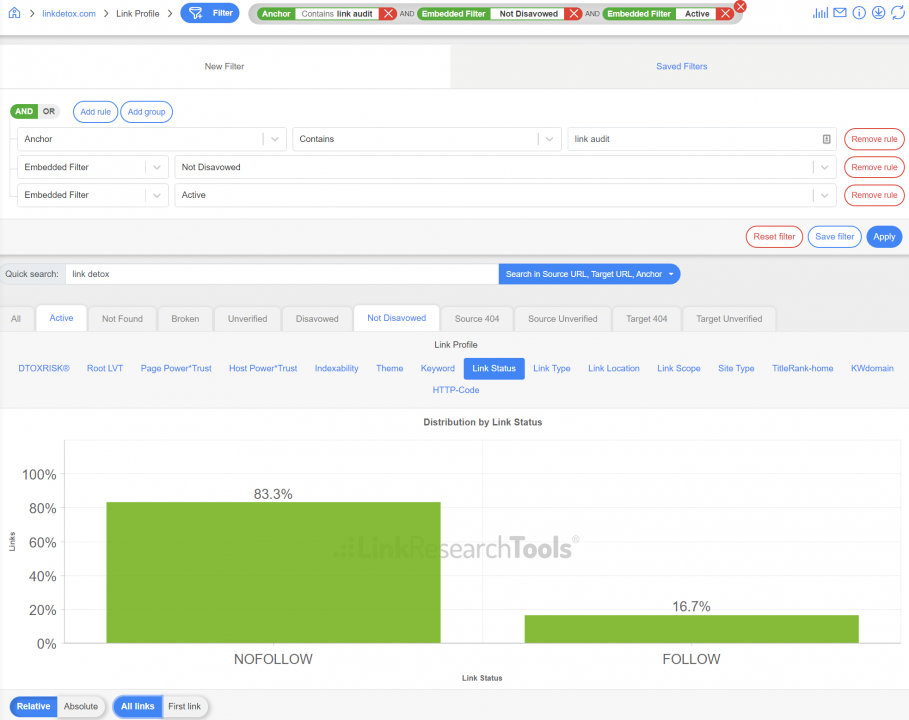

Wie Sie im folgenden (mit LinkResearchTools bearbeiteten) Beispiel sehen können:

- NoFollow-Links 75 %

- Follow-Links 25 %

für eine Keyword-Gruppe rund um „Link-Audit“, nicht disavowte Links und aktive Links (d. h. noch aktive Links, wie sie kurz vor dem Screenshot re-crawlt wurden)

Ein einfaches Verhältnis von 75 % zu 25 % (NoFollow zu Follow) für „Link Audit“

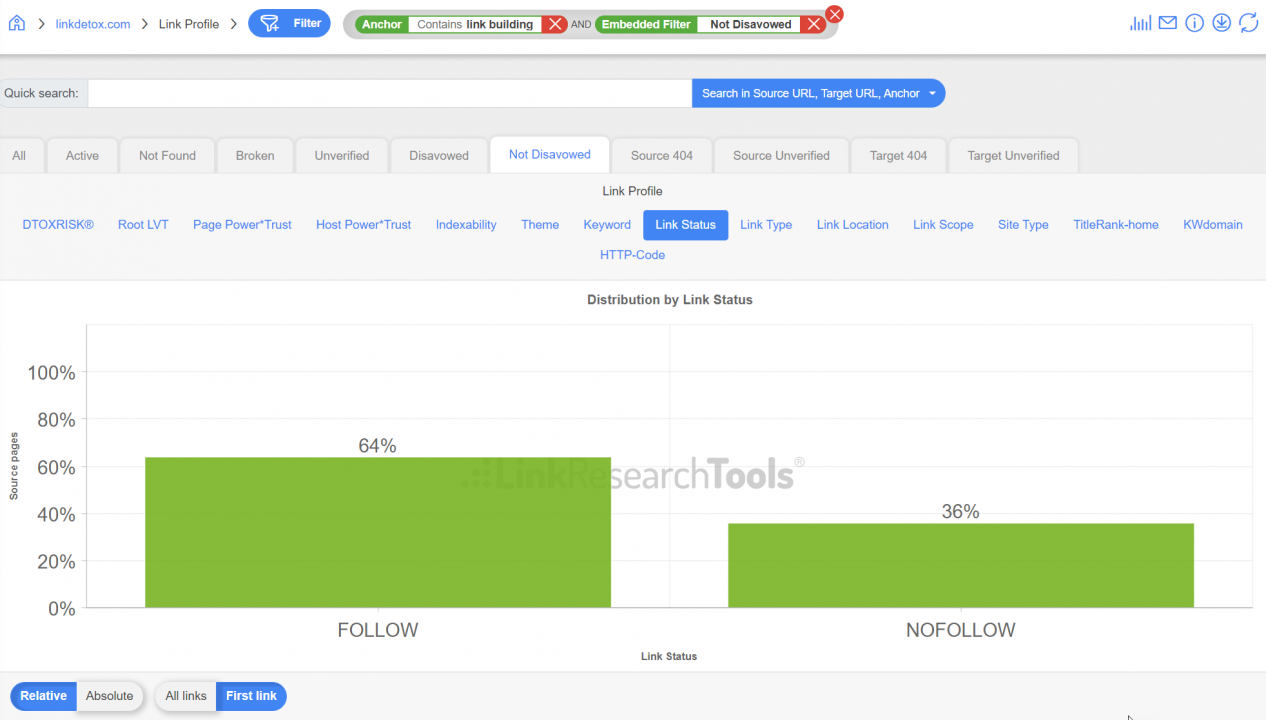

Unterschiedliche Link-Verhältnis für andere Themen, z. B. „Link-Building“

Wie Sie vielleicht schon erwartet haben, sehen die Zahlen für das Thema „Link-Building“ anders aus.

Das Link-Building ist zwar mit dem Link-Audit verwandt, fällt aber vom Arbeitsergebnis her ganz anders aus, und es sind unterschiedliche Teams oder sogar Dienstleistungsunternehmen beteiligt.

Auch heute noch kümmern sich nicht genug Link-Building-Firmen um das Risiko von Links. Sie versäumen es, einen Link-Simulator einzusetzen, um Links vor dem Aufbau zu prüfen, damit sie nicht später (nach einer Abstrafung) wieder aufwendig entfernt werden müssen.

Woher wir das wissen? Wir bieten schon seit 2014 einen Link-Simulator an und sehen mit Sorge, dass die Annahme eher gering ist. Der Grund ist leider typisch und einer weit verbreiteten Kurzsichtigkeit geschuldet. Die Link-Building-Firmen haben in der Regel keinen Anreiz, toxische Links NICHT aufzubauen, da ihre Bezahlung nicht an den Gesamtergebnissen, dem langfristigen Gesamterfolg und dem Risiko gemessen wird.

Aber zurück zum Thema. Wir halten fest: Für das Thema „Link-Building“ sind die Werte also anders.

- NoFollow-Links 36 %

- Follow-Links 64 %

für eine Keyword-Gruppe rund um „Link-Building“, nicht disavowte Links und aktive Links (d. h. noch bestehende Links, wie kurz vor dem Screenshot neu gecrawlt)

Ein Verhältnis von 64 % (Follow) zu 36 % (NoFollow) für „Link Building“

Follow-Links von 25 % auf 64 % gestiegen.Das ist nun wirklich ein ganz anderes Ergebnis.

Im Grunde aber ganz klar – der Markt für Link-Building ist anders als der Markt für Link-Audits.

Die SERPs für Link-Building sehen anders aus als die SERPs für Link-Audit.

Hätten Sie etwas anderes erwartet?

Wer immer noch auf eine allgemeingültige Daumenregel hofft,

dem ist nicht zu helfen. „42“ ;-).

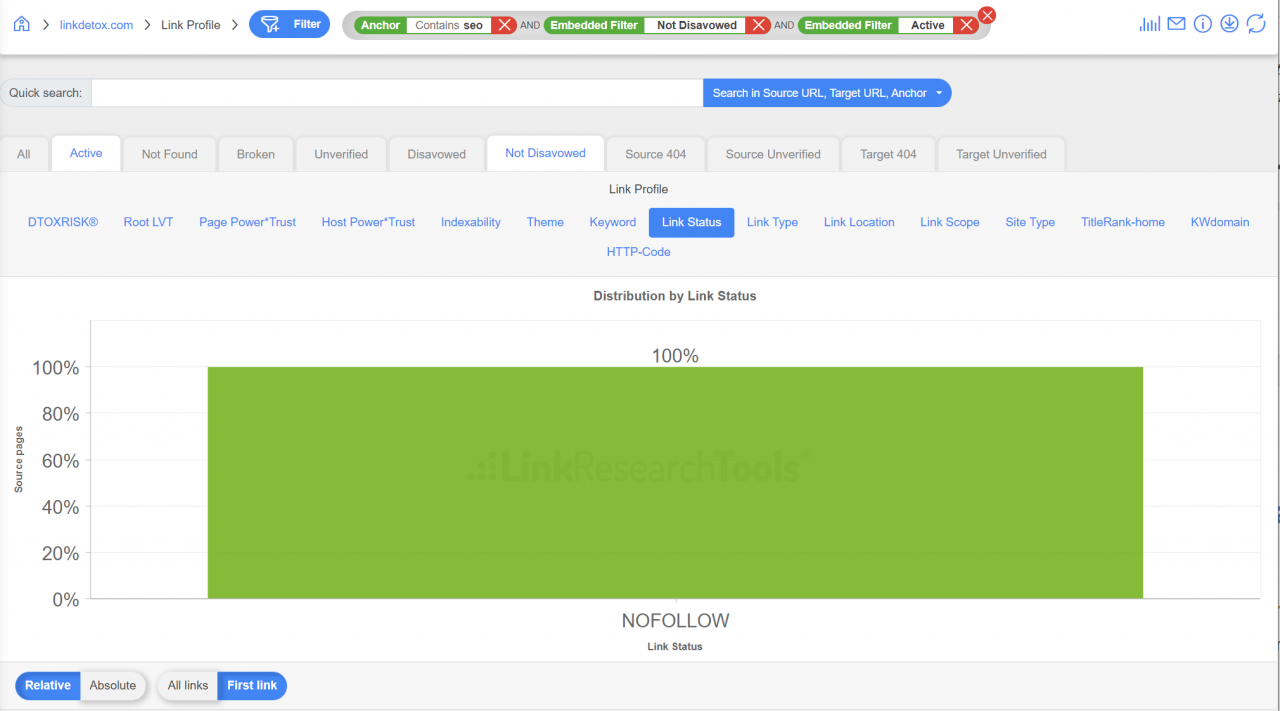

Ein weiteres Beispiel – Links für „SEO“: 100 % NoFollow

Was sagen Sie jetzt?

100 % für eine Keyword-Gruppe rund um „SEO“, nicht disavowte Links und aktive Links und

alle sind NoFollow (100 %).

Könnte DAS der Grund sein, warum die Website für Begriffe mit SEO-Bezug nicht so gut rankt?

Wir wissen es noch nicht; es gibt noch viele andere Faktoren und Dimensionen, die in diesem Linkprofil zu beachten sind.

Aber es ist eine ganz andere Sicht auf Ihre Links, wie Sie bestätigen werden.

Eine weitere Frage: Zählt dabei jeder Link?

Erster Link oder alle Links?

Eine verlinkende Seite kann mehrere Links enthalten.

Wie viele davon sind für unseren relativen Vergleich von Bedeutung?

Die SEO-Branche diskutiert die „First Link Count“-Regeln mittlerweile seit über einem Jahrzehnt und konnte sich bisher auf nichts einigen.

Wenn man der Meinung ist, dass alle Links zählen, will man damit sagen, dass alle Links auf allen Seiten, die die oben genannten Filter passieren, gezählt werden.

Folgt man dagegen der Meinung „Erster Link“, bedeutet das, dass pro Seite, die die oben genannten Filter passiert, nur der jeweils erste Link gezählt wird. So tickt die SEO-Welt schon seit vielen Jahren, und es gibt viele populäre Fallstudien und Tests.

Es scheint in dieser Frage kein Richtig oder Falsch zu geben.

Was ist IHRE SEO-Meinung\: Zählt nur der erste Link auf einer verweisenden Seite oder alle? Wenn Sie das bei Ihrer Prüfung nicht festlegen, sind die Zahlen wieder falsch.

Vergleichen Sie den folgenden Screenshot mit dem ersten Beispiel oben, in dem das Verhältnis 75 % (NoFollow) zu 25 % (Follow) betrug.

Huch, das kann doch nicht stimmen! So berechnet haben wir sogar noch WENIGER Follow-Links, nämlich nur noch 16,7 %.

BAMM – so kann es gehen! Ein Verhältnis von 83,3 % (NoFollow) zu 16,7 % (Follow).

Der gleiche Filter, aber eine andere Zählweise für verlinkende Seiten nach dem Umschalten auf Alle Links“.

Worüber reden wir hier überhaupt? Verstehen Sie, wie wichtig es ist, den Kontext Ihrer Messungen zu definieren?

Den Kontext Ihrer Metriken?

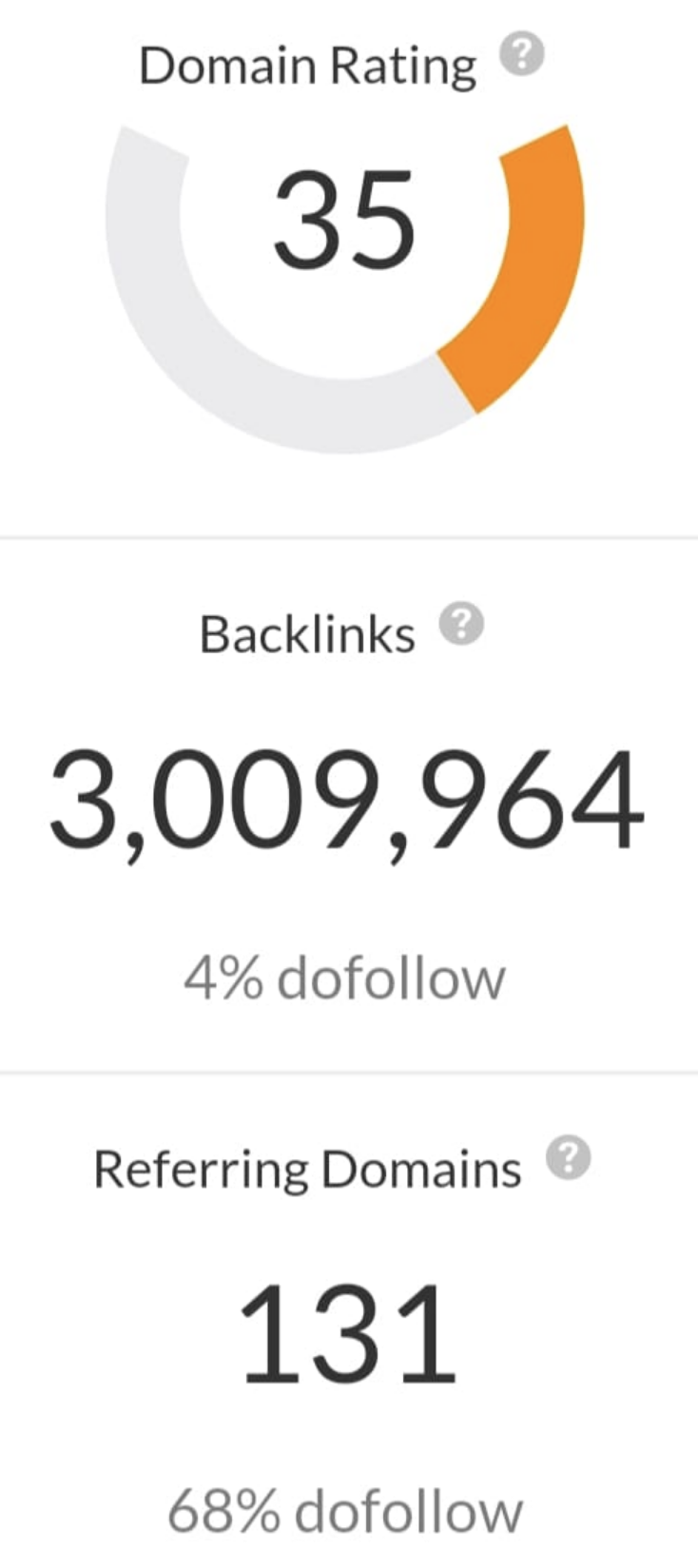

Das Problem der Verzerrung bei website-weiten Links

Das nächste Problem, mit dem Sie konfrontiert werden, wenn Sie Kennzahlen wie die oben genannten betrachten und vergleichen, ist das Problem der Site-Wide-Links.

Schauen wir uns noch einmal die Zahlen aus der einfachen Ansicht oben an.

Es gibt

- etwas über 3 Millionen Links und

- 131 verweisende Domains

- daraus folgt, dass jede Domain im Durchschnitt 22.976 Links beiträgt.

Da ist es wieder, dieses gefährliche arithmetische Mittel …

Trägt wirklich jede Domain fast 23.000 Links bei? Wahrscheinlich nicht.

Es ist wahrscheinlicher, dass eine Domain 2,99 Millionen (der etwas über 3 Millionen) Links beisteuert.

Und das bedeutet auch, dass, wenn der Site-Wide-Link, den Sie wahrscheinlich irgendwo im Footer haben, von NoFollow auf Follow geändert wird, sich ihr website-weites Verhältnis dramatisch ändern kann. Wahrscheinlich von 4 % auf 99 %.

Dies ist ein Proben-Problem, das von keinem Tool am Markt (mit Ausnahme von LinkResearchTools, soweit ich weiß) richtig gehandhabt wird.

In LinkResearchTools sorgen seit 2009 der „Site Wide Filter“ und später der „Intelligente Site Wide Filter“ dafür, dass wir nur eine sehr klar definierte und begrenzte Menge von website-weiten Links pro Domain heranziehen. Normalerweise sind das fünf Links, wie unsere Erfahrung zeigt. Einen vollständigen Artikel zum Thema „Site Wide Filter“ finden Sie hier.

Wenn Sie den Artikel zu den website-weiten Filtern gelesen und verstanden haben, dann lesen Sie bitte weiter. Andernfalls hören Sie hier auf zu lesen und lesen Sie den entsprechenden Artikel bitte erneut.

Inzwischen haben wir gelernt, dass es keinen Sinn hat …

- ein ungefiltertes Verhältnis von Follow- zu NoFollow-Links für die Analyse zu betrachten

- ein Verhältnis von Follow- zu NoFollow-Links zu prüfen, wenn Sie das Verhältnis von Links zu Domains nicht mit einem website-weiten haben

- ein ungefiltertes Verhältnis von Follow- zu NoFollow-Links zu analysieren, wenn ein Teil dieser Links disavowt ist

Selbst die Diskussion über die Massenanzahl, die Sie zu Beginn des Artikels gesehen haben, hat keinen Sinn.

Deshalb habe ich „42“ als Antwort gewählt, also eine generische und nutzlose Antwort auf eine generische und zu unpräzise Frage.

Warum zeigt mir dann ein „führendes SEO-Tool“ überhaupt einen Wert von „X % doFollow“ an?

Wozu ist diese Zahl überhaupt da?

Wir wissen es nicht.

Vielleicht hat ein „Anwender“ es der Firma vorgeschlagen?

Vielleicht, weil irgendjemand mal behauptet hat, das sei so brauchbar. Vielleicht hat auch einfach noch niemand an die Komplexität relativer Vergleiche gedacht, bei denen eine Normalisierung der Daten über einen Site Wide Filter erforderlich ist, wenn man unsinnige Ergebnisse vermeiden möchte.

Warum unsinnig, fragen Sie? Bitte lesen Sie diesen Artikel noch einmal.

Fragen, die (mehr) Sinn ergeben

Hier sind einige richtige Fragen, die Sie stellen müssen

-

Für welche Keywords oder Themen versuche ich zu ranken?

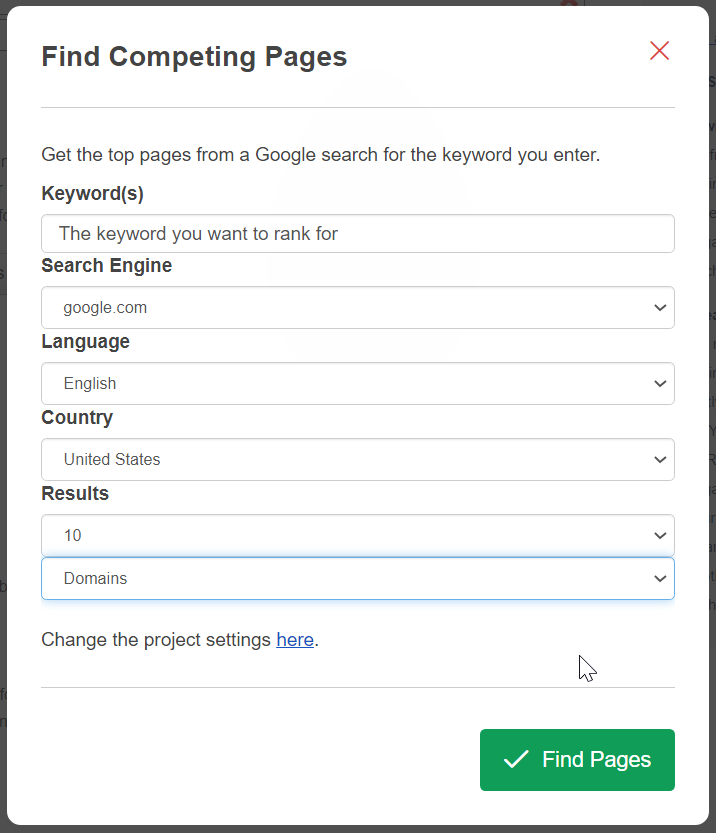

Es ist sinnvoll, die Recherche im Competitive Landscape Analyzer (CLA) anhand dieser Informationen durchzuführen.

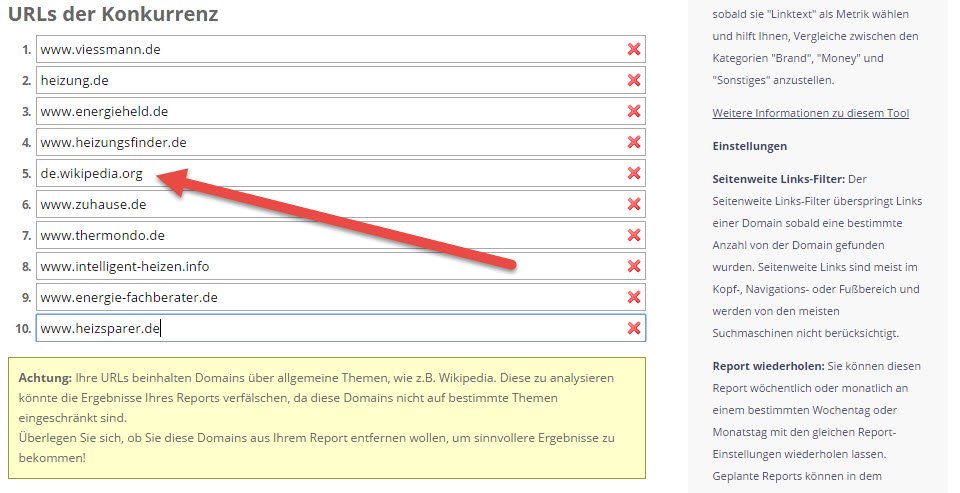

- Welche anderen Websites sind auf der SERP? Welches sind die Top 10 oder Top 30 der rankenden Seiten?

Eine Funktion wie die obige „Suche nach konkurrierenden Seiten“ in LRT oder eine einfache Google-Suche (wenn sie richtig durchgeführt wird) kann Ihnen weiterhelfen.

Seien Sie sich aber bewusst, dass einige Domains, wie z. B. Wikipedia, umstandslos ausgeschlossen werden sollten. Es ist von vorneherein sinnlos, mit ihnen konkurrieren zu wollen oder einen Großteil des Analysebudgets auf sie zu verwenden.

- Mit welchen Landing-Pages oder Inhaltsbereichen vergleichen Sie sich?

Lustigerweise hat „userergsaid“ oben gesagt: „Seiten ranken, nicht Websites“. Seiten brauchen gute Inhalte. Wir haben nicht einmal angefangen, das zu untersuchen.

- Wie hoch ist mein Ankertextverhältnis? Schlüsselwörter „Brand“ oder „Money“ Auch heute noch überoptimieren viele Websites ihre Money-Keywords. Andere sind so paranoid oder schlecht im Outreach, dass sie ihre Money-Keywords nicht im Linkprofil haben. Das ist nicht „Pinguin-sicher“ (wie sie glauben), sondern „erfolgsfrei“. Braucht man ein paar Money-Keywords in seinem Linkprofil, fragen Sie? JA!

- Wie gut ist meine Linkqualität? Wir haben noch nicht einmal die Power und den Trust der Links betrachtet, ganz zu schweigen vom Linkrisiko. Alles, was wir oben gesehen haben, war eine „domainweite Bewertung“ für die Domain und das Verhältnis von Follow- zu NoFollow-Links. Wie Sie vielleicht erraten können, ist das nicht genug. In diesem Video finden Sie noch weitere aufschlussreiche Beispiele.

- Wie hoch ist mein Linkrisiko? Selbst wenn Sie einige großartige Links haben, können sich toxische Links als üble Stolpersteine erweisen. Das gilt auch für solche toxischen Links, die bereits entfernt, aber nach dem Disavow noch nicht wieder gecrawlt wurden.

- Welche Art von Links für welche Zeit? Geht es hier um eine statische Bewertung? Oder möchten Sie eigentlich wissen, wie viele Follow-Links und NoFollow-Links Sie in Ihrem SEO-Prozess künstlich herstellen sollten? Das neuere Linkwachstum könnte sich sowohl in Bezug auf Qualitätskriterien als auch auf die Linkgeschwindigkeit SEHR vom gesamten Backlink-Profil unterscheiden. Es gibt also noch mehr Fragen.

Zu viele Fragen, um sie zu beantworten? Ich verstehe Ihr Sorge. Diese Fragen sind nicht einfach, und seit 18 Jahren wache ich jeden Morgen auf und denke über diese Dinge nach.

Deshalb reicht meine ursprüngliche Antwort „42“ für einige, die SEO und Linkanalyse nicht ernst genug nehmen, aus.

Seien Sie sich nur darüber im Klaren, dass sich diese Zeitgenossen mit Zufälligkeiten in einer trügerischen Sicherheit wiegen. Mit Forschung oder Best Practices hat das, meiner Meinung nach, nichts zu tun.

Die Betrachtung des Verhältnisses von Follow- zu NoFollow-Links ist möglich, sollte aber gut gemacht sein.

Der obige Screenshot aus dem nicht namentlich genannten Tool ist ein Beispiel, wie man es nicht machen sollte.

Solche gewagten Metriken „aus dem Hut zu zaubern“ sorgt nur für Verwirrung. Die Nutzer verfolgen dann Scheinziele und vergleichen „Äpfel mit Birnen“ (denken Sie nur an den website-weiten Linkfilter). Das Ergebnis können Sie sich ausmalen …

Davon abgesehen, gibt noch viele weitere Aspekte, die man bei sachgerechter SEO und beim guten Link-Building beachten muss. Ein Wortungetüm wie die oben zu sehende „Sitewide Global Unfiltered and Not-normalized Dofollow Ratio“ gehört aber ganz sicher nicht dazu.

Noch eine Bemerkung zu den Begriffen „Dofollow“ und „Follow“

„Dofollow“ ist ein Begriff, der durch ein beliebtes SEO-Tool bekannt gemacht wurde. Dofollow steht für „Follow“-Links, oder einfach „Links“.

Zum Verständnis: Links hatten schon immer ein bestimmtes Verhalten, und es war und ist kein Befehl notwendig, um „ihnen zu folgen“. Weder der Bedeutung nach, noch in der HTML-Syntax. Wir könnten stattdessen „68 % Folge-Links“ sagen, und es wäre immer noch klar. Im Laufe der Zeit hat jedoch die zweite Variante an Beliebtheit bei neuen SEOs gewonnen.

Und was ist mit NoFollow 2.0?

Wenn Sie den Artikel über NoFollow 2.0 gelesen haben und zu dem Schluss gekommen sind, dass wir Links in anderen, hilfreicheren Dimensionen analysieren sollten als bloß das Verhältnis von Follow- zu NoFollow-Links, dann stimme ich Ihnen zu.

Lassen Sie mich wissen, was Sie meinen!

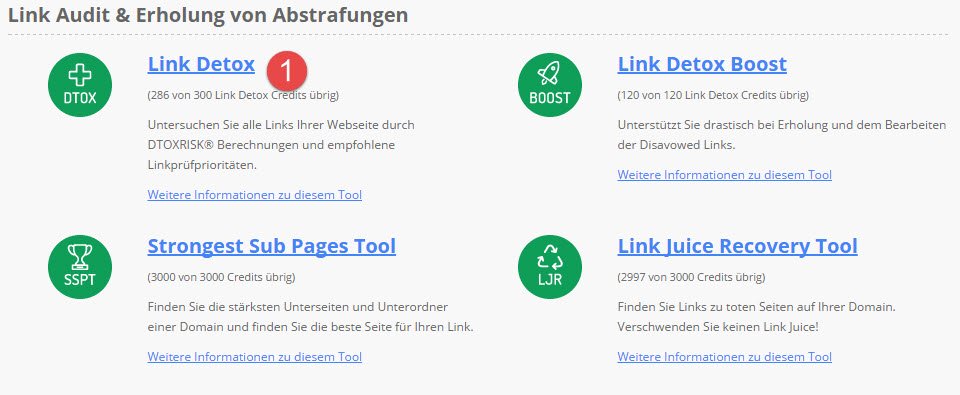

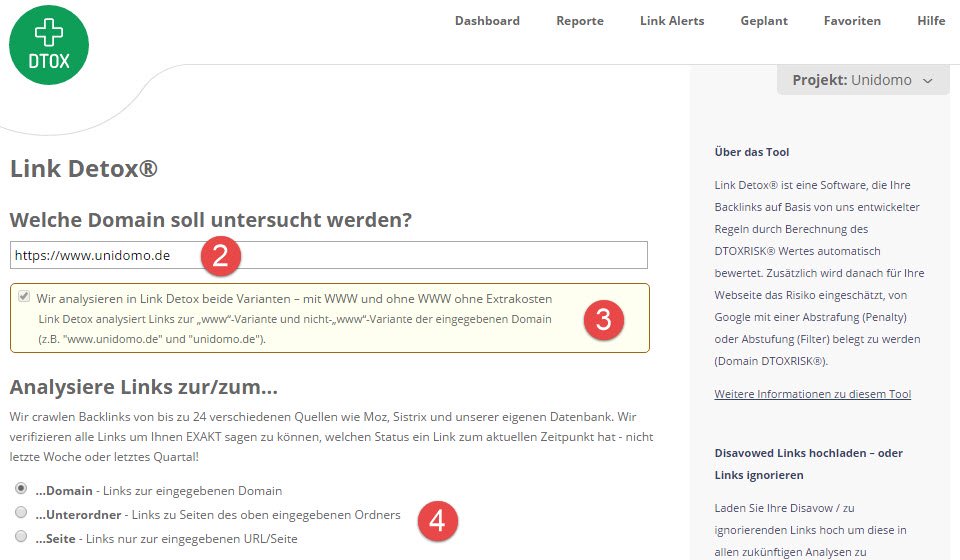

Hier ein Überblick über die neuen Funktionen und Verbesserungen, die wir in den letzten Wochen in LinkResearchTools (LRT) eingeführt haben.

- Ein kurzer Überblick über die Benutzerschnittstelle (UI) von LRT Smart

- Zugriff auf 25 zusätzliche LRT Classic Tools

- Schnellsuche nach Link-URLs und Ankertexten

- Quick Backlink Checker und Link Detox Risk Live

- So verwenden Sie den Quick Backlink Checker

- Tool Switcher oder das Symbol „Quick Backlink Checker“

- Link-Kontextsymbol

- Beispiel für die Nutzung von QBL Smart

- Link Detox Risk Live

- Neue SEO-Audit-Berichte im PDF-Format

- Was sind die PDF-Berichte in LRT?

- So verwenden Sie die LRT-PDF-Berichte

- Link Building Simulator

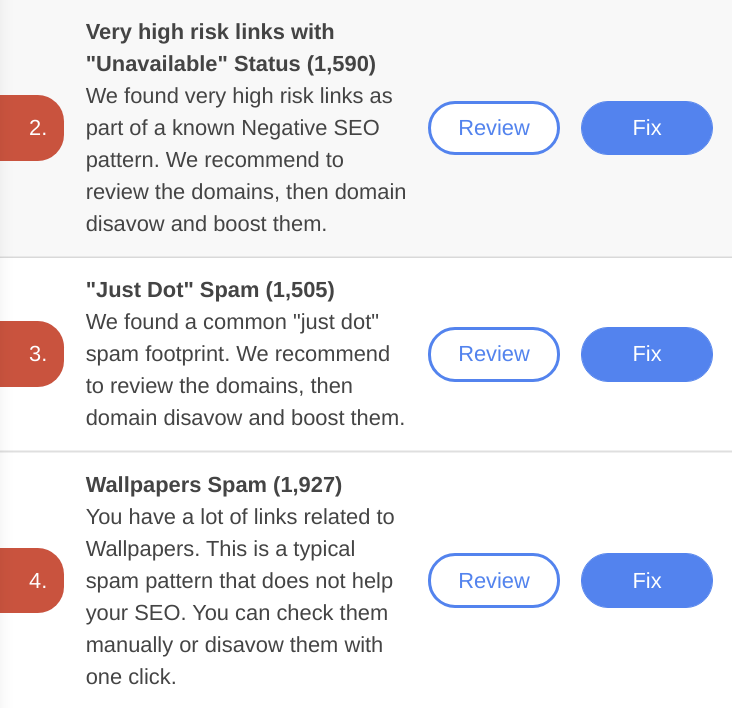

- Neue Link-Audit-Probleme für „Dot Spam“ und „Wallpapers Spam“

- Übersicht der Projekteinstellungen

- Bedarfsgesteuerte Re-Crawls in LRT Smart

- Datenfrische und Genauigkeitsbericht

- Weitere Verbesserungen

- Welche SEO-Metriken sollten Sie verwenden?

- Paket- und Preisänderungen

- Neue Quartals-Pakete

- Nur Link Detox Boost buchen

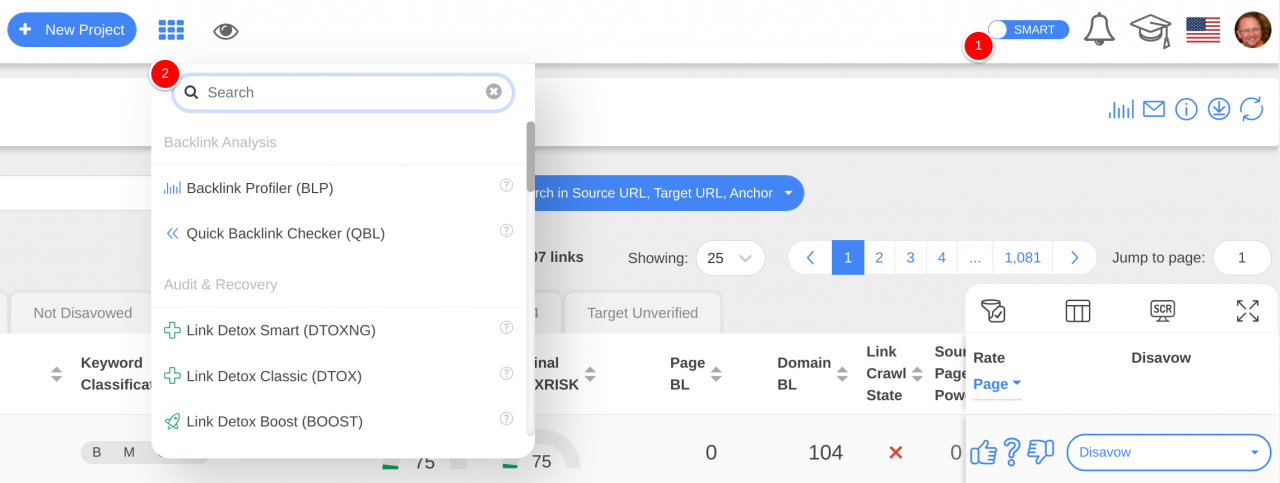

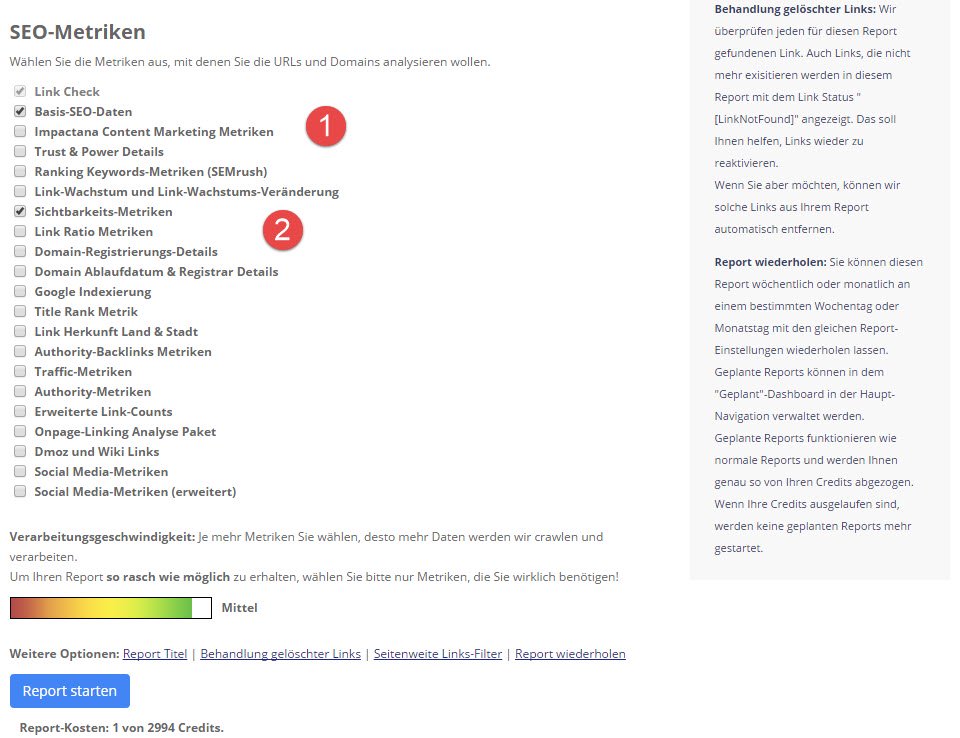

Ein kurzer Überblick über die Benutzerschnittstelle (UI) von LRT Smart

LRT Smart ist unsere neue Produktgeneration, die wir Ihnen unten in einem kurzen Einführungsvideo vorstellen. Wenn Sie eines der „Superhero“-Pakete haben, können Sie alle LRT Classic Tools weiterhin nutzen. Viele unserer treuen Langzeitkunden schätzen diese Funktionen und nutzen sie weiterhin intensiv in ihrer Arbeit.

Zugriff auf 25 zusätzliche LRT Classic Tools

Als Kunde mit einem Superhero-Paket haben Sie Zugriff auf die LRT Smart UI sowie auf alle 25 LRT Classic Tools.

Das bedeutet: Auch wenn Sie mit LRT Smart arbeiten, können Sie auf Wunsch immer auf die Classic Tools zugreifen. Wenn Sie ein Superhero-Konto haben, wechseln Sie dazu einfach zur „Classic“-Ansicht 1 oder verwenden den Tool Launcher 2.

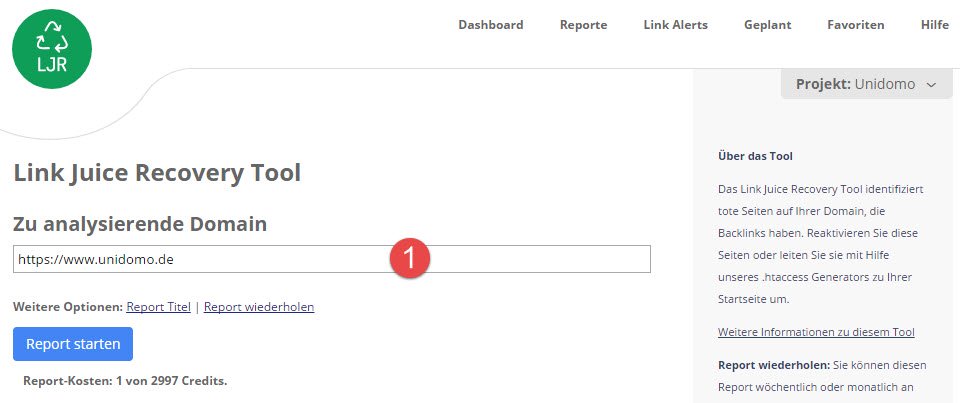

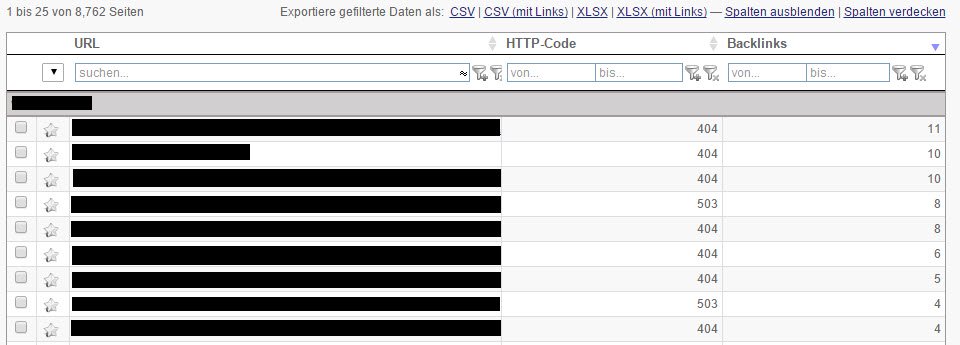

Sie können die Classic Tools von LRT (z. B. Link Juice Recovery) sogar im Hintergrund laufen lassen und währenddessen in LRT Smart weiterarbeiten.

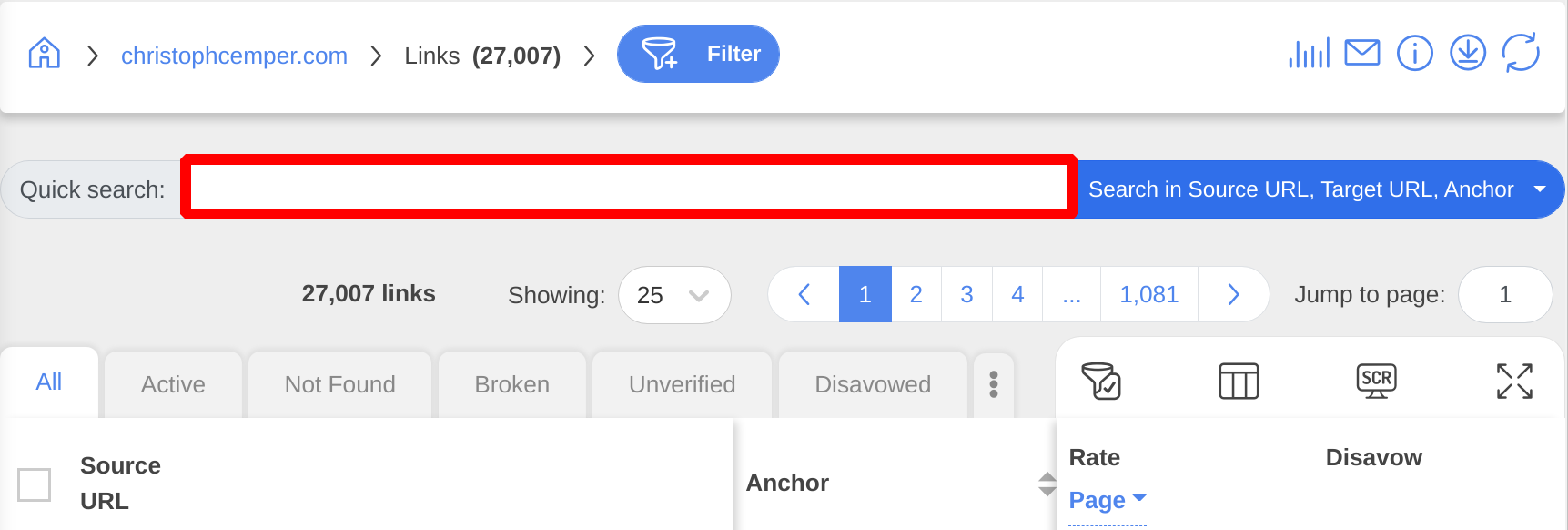

Schnellsuche nach Link-URLs und Ankertexten

Einige Benutzer haben uns berichtet, dass sie die alte Table Control von LRT Classic sehr vermissen. Wir verstehen das und arbeiten im Moment aktiv daran, eine andere Table Control für LRT Smart zu erstellen, die allen Nutzerwünschen gerecht wird.

In der Zwischenzeit haben wir eine Funktion ausgerollt, die auch in LRT Classic noch fehlte – eine Schnellsuche.

Mit unseren komplexen Filtern können Sie alle Arten von ausgefallenen Filterkombinationen erstellen, aber für eine effektive Suche sind Filter meist zu umständlich.

Die Schnellsuche bietet Ihnen daher ein einziges Suchfeld, mit dem Sie nach den beliebtesten Elementen, etwa der Quell- und Ziel-URL, dem Ankertext oder Kombinationen davon, suchen können.

Quick Backlink Checker und Link Detox Risk Live

In LRT Smart hatten wir eine Zeit lang den Quick Backlink Checker (QBL).

Hier ist ein Überblick dazu – und ein Teaser für DTOXRISK Live.

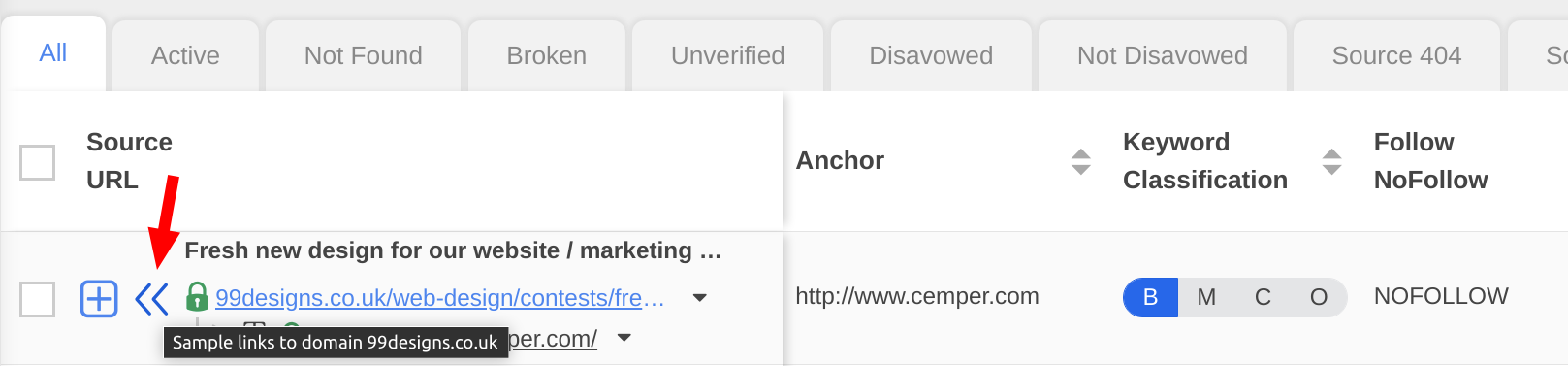

Link-Kontextsymbol

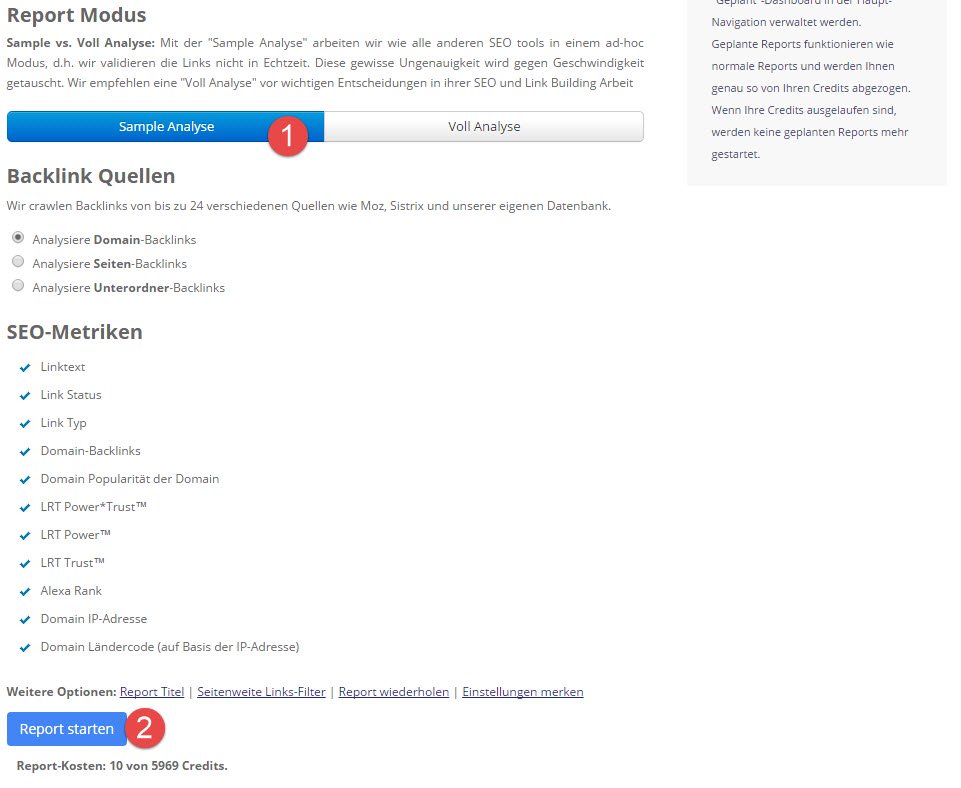

Als Langzeitnutzer bevorzugen Sie zum Starten von QBL vielleicht das klassische Kontextmenü, in dem Sie auch den Analyseumfang für Ihren Sample Backlink Report in QBL auswählen können.

- Sample Backlinks für die Seiten-URL

- Sample Backlinks für die Subdomain

- Sample Backlinks für die Root-Domain

Beispiel für die Nutzung von QBL Smart

In nur wenigen Sekunden haben Sie eine schnelle Backlink-Analyse vorliegen, erstellt auf Basis einer Stichprobe der Backlinks aus einer statischen Linkdatenquelle (also nicht re-crawlt, wie wir es normalerweise tun).

Für eine schnelle Überprüfung reicht das aus, denn es geht ja nur darum, sich einen kurzen Überblick über eine Domain zu verschaffen, die Sie noch nie gesehen haben.

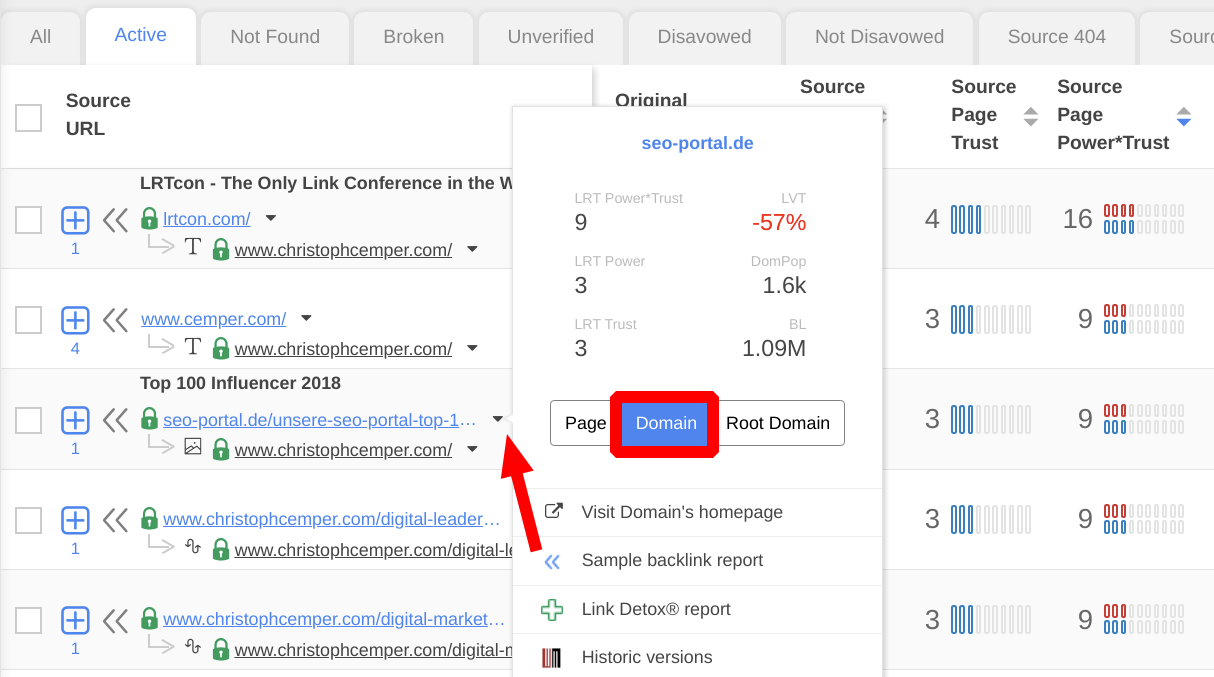

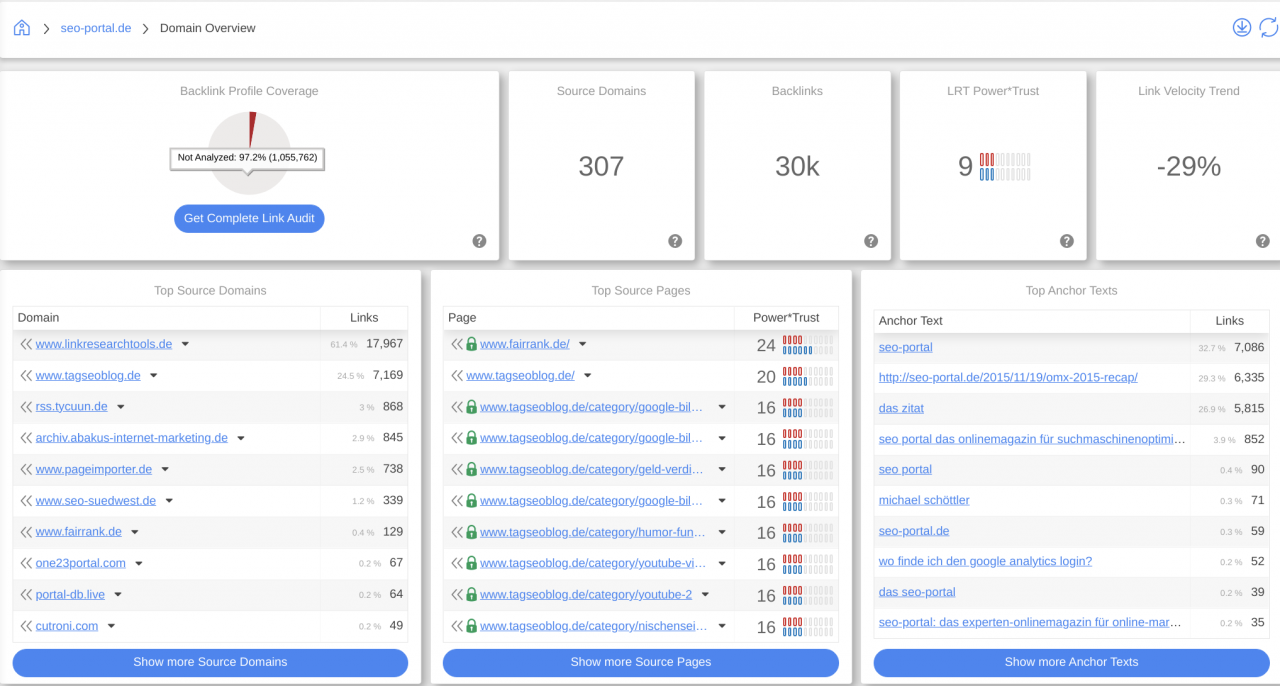

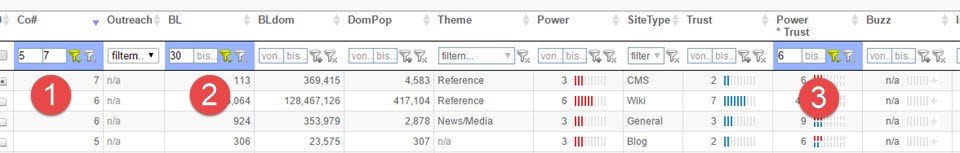

Dieser Bildschirm zeigt eine beispielhafte Ansicht in QBL Smart. Dort sehen Sie:

- die Top-Auswahl der Quell-Domains

- die Top-Quellseiten mit ihrem LRT Page Power*Trust

- die Top-Liste der verlinkenden Ankertexte

- den Backlink-Profil-Abdeckungsgrad der Analyse (normalerweise „mikroskopisch“ für QBL)

- die Anzahl der Quell-Domains (im Beispiel angezeigt)

- die Anzahl der Backlinks (in der Abbildung dargestellt)

- LRT Power*Trust für die Domain

Denken Sie daran: Im QBL sehen Sie nur einen kleinen Ausschnitt des Backlink-Profils.

Sobald Sie sich einen ersten Überblick über das Backlink-Profil verschafft haben, empfiehlt es sich, eine vollständige Analyse durchzuführen.

Link Detox Risk Live

Link Detox Risk Live ist die neue Funktion zum Einschätzen der Linkqualität und des potenziellen Risikos, das ein Link für Sie bedeutet. Link Detox Risk Live ist schnell und läuft nahezu in Echtzeit.

Die Grundidee ist ebenso einfach wie clever: Warum sollten Sie Links aufbauen, die hinterher Ärger, Ranking-Verluste und Abstrafungen einbringen? Viel schlauer ist es, diese Links gleich von Anfang an auszusieben.

Neue SEO-Audit-Berichte im PDF-Format

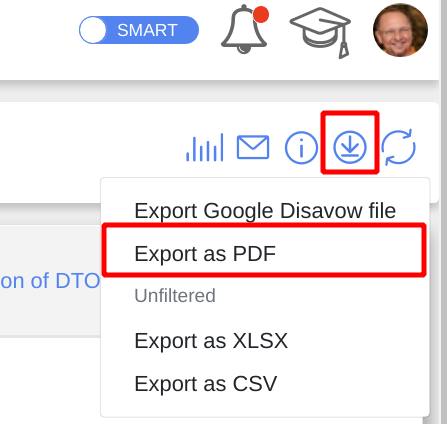

Was sind die PDF-Berichte in LRT?

LRT hat jetzt eine völlig neue Funktion für wunderhübsche PDF-Berichte, auf die viele Benutzer schon lange gewartet haben.

Mit nur einem Klick können Sie einen PDF-Schnappschuss von allem, was Sie im aktuellen Projekt in LRT Smart sehen (und mehr), erstellen.

So sind einige Berichtselemente derzeit nur im PDF oder in den Projekt-E-Mail-Benachrichtigungen sichtbar.

Die neuen, wunderhübschen PDF-Berichte sind jetzt in allen Paketen ab Superhero Standard und aufwärts verfügbar. Benutzer von Legacy-Plänen und Link Detox-Plänen müssen ein Upgrade durchführen, um die neuen Berichte nutzen zu können.

Das folgende Video gibt Ihnen einen schnellen Überblick über den Inhalt der PDF-Berichte in LRT:

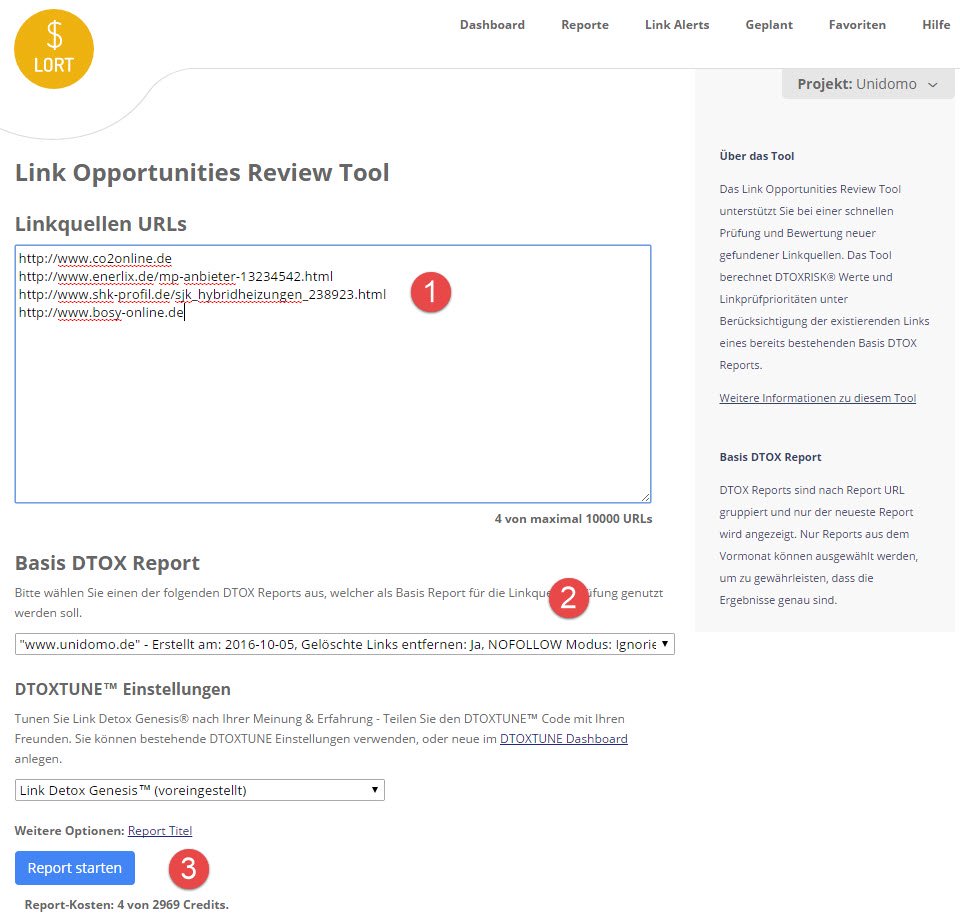

Link Building Simulator

Um gesunde und robuste Links aufzubauen, nutzen Sie am besten den Link Building Simulator in LRT Smart. Diese von uns seit 2014 angebotene Technologie hat jetzt einen ganz neuen Look und bietet noch mehr Funktionen.

Sehen Sie sich die folgende kurze Video-Demo an, um zu sehen, wie der Link Building Simulator (früher bekannt als „LORT“) heute aussieht.

Bedarfsgesteuerte Re-Crawls in LRT Smart

Datenfrische und Genauigkeitsbericht

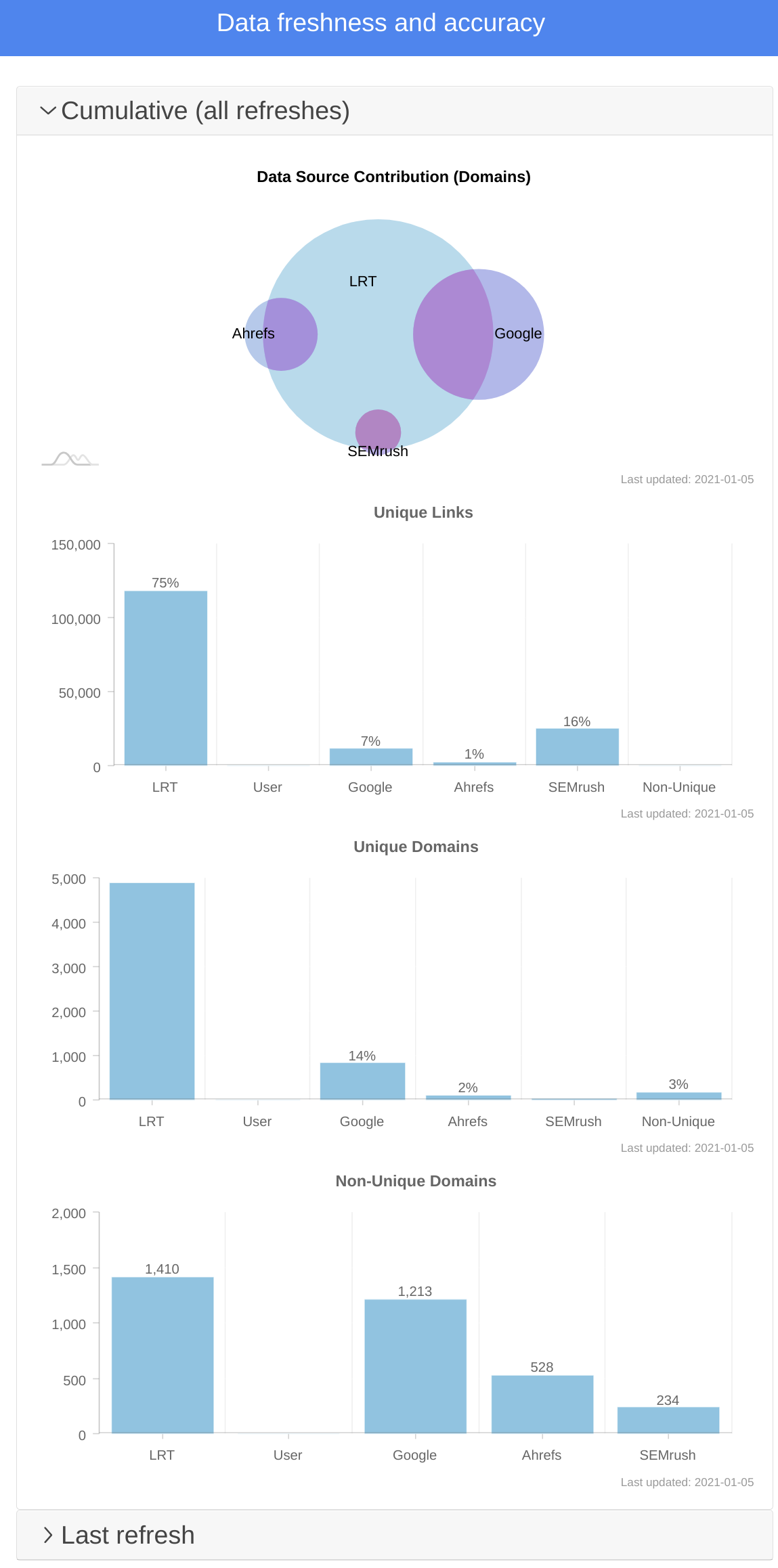

Würden Sie gerne wissen, wie viel diese zusätzlichen Link-Datenquellen zu Ihren LRT-Projekten beitragen?

Dieser neue Bericht zeigt Ihnen Überschneidungen von Datenquellen und ihren Beitrag zum Gesamtergebnis.

Wie Sie sehen, ist das Hinzufügen der Verbindung zur Google Search Console die mit Abstand vielversprechendste Maßnahme, wenn Sie die Abdeckung Ihrer Backlink-Profile in den Berichten verbessern wollen.

Diese Berichtsfunktion befindet sich noch in der Beta-Testphase mit Pilotbenutzern und der internen Überprüfung der Ergebnisse unseres Teams.

Weitere Verbesserungen

- Unterstützung des Disavow-Tools in der neuen Google Search Console

- Neuer Integrationsabschnitt im LRT Smart Wizard zum Hinzufügen von API-Schlüsseln von Ahrefs und SEMrush

- Verbesserte automatische Erkennung von Datenbeschädigungen für einige Domains

Welche SEO-Metriken sollten Sie verwenden?

In dem Video „Welche SEO-Metriken sollten wir beim Linkbuilding verwenden?“ lernen Sie, wie wichtig es ist, sich für den Linkaufbau oder die Bewertung der Linkqualität im Allgemeinen auf die richtigen Metriken zu konzentrieren.

Gerade in diesem wichtigen Bereich machen Vermarkter und Leute in der SEO-Branche leider immer wieder Fehler.

Viele verwenden domainbasierte Metriken wie Ahrefs DR oder Moz DA, wenn sie die Wirkung eines Links auf eine Seite erklären wollen – aber das funktioniert so nicht. Wie der Name schon sagt, dienen domainbasierte Metriken zur Messung von Domains.

Paket- und Preisänderungen

Neue Quartals-Pakete

Alle Superhero-Pakete können Sie jetzt auch mit vierteljährlicher Zahlungsweise buchen. Damit erhalten Sie alle Kontingente (wie das Link Crawl Budget) im Voraus für einen Monat und schonen zugleich Ihr Bankkonto, da nicht gleich für ein ganzes Jahr abgebucht wird.

Nur Link Detox Boost buchen

Einige Benutzer möchten nur Zugang zu Link Detox Boost haben, deshalb bieten wir das jetzt in einem eigenständigen Einzelpaket an.

Wenn Sie NUR die einzigartigen Fähigkeiten von Link Detox Boost als Einzelprodukt nutzen wollen, dann haben wir jetzt etwas für Sie:

das „Link Detox Boost“-Jahrespaket.

Das Paket sieht folgendermaßen aus:

- Link Detox Boost (als Einzelprodukt)

- als Einzelpaket mit jährlicher Zahlungsweise

- 500 Link Detox Boost Credits

- das bedeutet, dass Sie insgesamt 150.000 URLs boosten können

- Laufzeit: 1 Jahr

Alle Credits sind ebenfalls ein Jahr lang gültig.

Und Sie können Ihre Boost Credits über das gesamte nächste Jahr, d. h. die nächsten 365 Tage, verteilen.

Links sind einer der Top-Ranking Faktoren

Google hat offiziell bestätigt, dass für ein gutes Ranking zwei Faktoren ausschlaggebend sind:

Links und Content.

Es ist falsch zu denken, dass nur große Unternehmen und erfahrene Agenturen in der Lage sind, ein hohes Ranking zu erhalten.

Ob Sie ein kleines Unternehmen, eine Ein-Personen-Firma oder ein internationaler Großkonzern sind, macht keinen Unterschied. Jeder hat das Ranking selbst in der Hand.

Sie müssen nur wissen wie.

LRT Certified Professional Benjamin Mylius erklärt aus erster Hand, wie gerade kleine Unternehmen ihr Ranking durch einen guten Linkaufbau verbessern können.

Anhand seiner detaillierten Ausführungen wird es auch für Sie ein Leichtes, eine erfolgreiche Linkbuilding Strategie zu entwickeln.

- Genießen und Lernen Sie!

Christoph C. Cemper

und das Team von

LinkResearchTools (LRT)

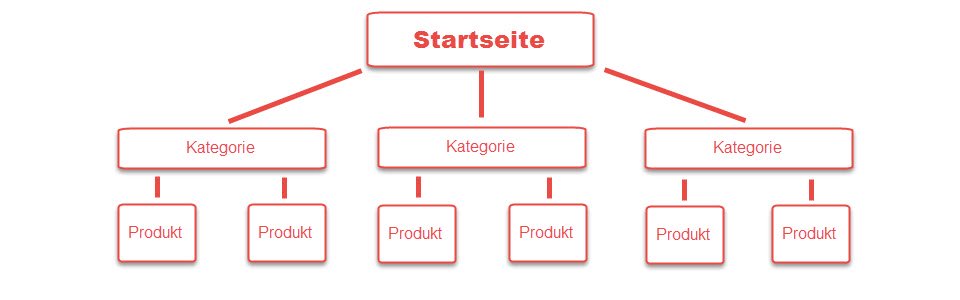

Einleitung

Suchmaschinenoptimierung lässt sich grob in drei Kernbereiche aufteilen. Jeder einzelne dieser Bereiche muss gut gepflegt und optimiert werden, damit der Erfolg einer Webseite auch gesichert werden kann. Ist auch nur eine der Säulen marode oder steht auf wackeligem Boden, ist das ganze Konstrukt einsturzgefährdet. Somit auch das eigene Business, das an den Erfolg der Webseite geknüpft ist.

Wie teilen sich diese drei Kernbereiche auf?

Technische SEO

Dieser Bereich umfasst alles, was mit der Technik verknüpft ist, die für eine Webseite oder deren Korrektheit benötigt wird. Begonnen bei der Ladegeschwindigkeit über die korrekte Verwendung von Canonicals, clean URLs, Redirects bis hin zu den korrekten HREF Lang Tags.